2026年UI/UX设计界震撼!AI工具崛起,传统设计岗位需求锐减30%,AI体验设计师薪资却飙升50%!

别只做美工了!你的设计思维代码能力正是AI时代最稀缺的\"人机交互翻译器\" 一、设计者的\"觉醒时刻\":当Figma开始自动生成...

别只做美工了!你的设计思维代码能力正是AI时代最稀缺的\"人机交互翻译器\" 一、设计者的\"觉醒时刻\":当Figma开始自动生成...

第九章 上下文工程 9.1 什么是上下文工程 在经历了数年提示工程(Prompt Engineering)成为应用型AI的焦点之...

作者:飞哥(一位喜欢讲故事的全栈开发者,擅长把复杂的代码翻译成“人话”) 阶段:GenAI...

文章浏览阅读1k次,点赞34次,收藏26次。本文介绍了GPT-2模型的训练与微调过程。首先回顾了模型架构的关键组件,包括分词器、注意力机制等。重点阐述了训练目标...

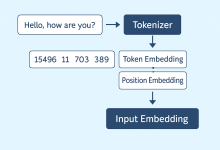

文章浏览阅读304次,点赞5次,收藏3次。本文介绍了GPT-2模型处理文本输入的实现方法,主要包括两个关键步骤:首先使用Tokenizer将自然语言文本转换为t...

文章浏览阅读1k次,点赞36次,收藏17次。本文介绍了在4卡4090服务器上部署GraphRAG环境的过程。硬件配置包括双路至强金牌6148处理器、128GB内...

文章浏览阅读1.1k次,点赞27次,收藏10次。本文分享了在纯CPU服务器上优化Embedding模型部署的经验。原方案使用Hugging Face的trans...

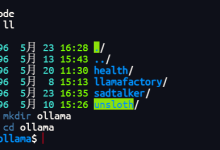

文章浏览阅读811次,点赞29次,收藏8次。本文详细介绍了在配备4块NVIDIA 4090显卡的高性能服务器上部署Ollama环境的全过程。内容包括:硬件配置(...

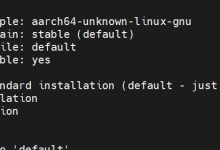

文章浏览阅读5.9k次,点赞23次,收藏18次。昇腾推理服务器部署embedding和rerank相关的RAG模型_昇腾部署embedding