Self-Attention原理和实现代码(Pytorch实现)

文章目录一、Self-Attention原理二、Self-Attention代码实现1.单头注意力单头注意力的代码实现2.多头注意力多头注意力的计算流程多头注意...

文章目录一、Self-Attention原理二、Self-Attention代码实现1.单头注意力单头注意力的代码实现2.多头注意力多头注意力的计算流程多头注意...

引言:NLP领域的范式转移 2017年,谷歌的研究团队在论文《Attention is All You Need》中提出了一种全新的神经网络架构——Trans...

前言:推开那扇通往“上帝视角”的门 🌪️ 一场静悄悄的革命 把时针拨回 2017 年。 那时候的 AI 还在费劲地像小学生一...

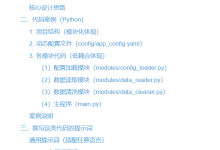

LLM:代码撰写的提示词 目录 LLM:代码撰写的提示词 一、核心概念与设计原则 核心设计思路 二、代码案例(Python) 1. 项目结构(模块化体现) 2....

第一步:准备数据 6种蝴蝶数据:self.class_indict [\"曙凤蝶\", \"麝凤蝶\", \"多姿麝凤蝶\", ...

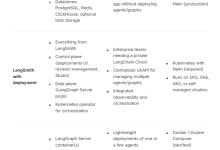

langgraph 1.0正式版本后,有三种部署的方式, 先说结论: 如果只是部署自己的langgraph服务 使用独...

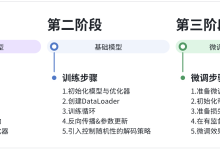

接前置文章: 从零构建大模型读书记录(一)——理解大语言模型 从零构建大模型读书记录(二)——处理文本数据 从零构建大模型记录(三)——从零...

文章浏览阅读588次,点赞20次,收藏19次。本文总结了人工智能领域六大创新模型组合方向及其研究价值:1. Transformer+CNN实现全局-局部特征互补...

文章浏览阅读826次,点赞10次,收藏23次。本文介绍了参数高效微调(PEFT)技术及其在自然语言处理中的应用。文章首先探讨了如何选择适合的预训练模型,以文本风...

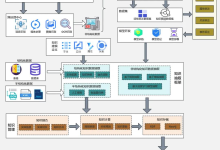

文章浏览阅读196次,点赞8次,收藏8次。引言大模型应用架构是连接基础模型能力与实际业务场景的关键桥梁,它通过系统化的设计,将大模型的潜力转化为可落地的解决方案...