分布式机器学习中的拜占庭容错:Krum算法实战解析与代码实现

在分布式机器学习的广阔战场上,我们常常为模型训练的效率提升而欢欣鼓舞,但一个幽灵始终在协作的边缘徘徊——那就是“坏节点”的威胁。想象一下,你精心设计的联邦学习系统,有成百上千个设备参与训练,其中几个设备因为硬件故障、网络丢包,甚至更糟,是恶意攻击者伪装的,它们提交的模型更新是随机的、甚至是精心构造的破坏性数据。这就像一支交响乐团里混入了几个故意跑调的乐手,最终可能导致整场演出失败。传统的容错机制对这类“说假话”的节点往往束手无策,这正是拜占庭容错问题在机器学习领域的核心挑战。

今天,我们不谈空洞的理论,而是聚焦于一个被学术界和工业界反复验证的实用武器:Krum算法。这篇文章是为那些真正在构建分布式学习系统的工程师和研究者准备的。我们将绕过繁琐的公式推导,直接切入实战,用代码和案例告诉你,如何在你的下一个PyTorch或TensorFlow项目中,集成Krum算法来抵御那些“拜占庭”节点,确保你的模型在“嘈杂”甚至“敌对”的环境中依然稳健收敛。无论你是在构建跨设备的隐私计算平台,还是在设计一个抗攻击的区块链AI应用,理解并实现Krum都将是你工具箱里至关重要的一环。

1. 拜占庭问题:分布式机器学习中的“内鬼”挑战

在深入Krum之前,我们必须先弄清楚敌人是谁。拜占庭将军问题是一个经典的分布式系统容错理论模型,它描述了一种最恶劣的故障场景:系统中的某些组件(节点)不仅可能发生故障而停止响应,更可能以任意方式“作恶”——发送矛盾或错误的信息给其他组件。在机器学习语境下,这意味着参与训练的某些客户端(或工作节点)可能提交的梯度更新是:

- 随机的噪声:例如,由于内存错误或计算单元故障,产生无意义的张量。

- 有偏的误导:恶意攻击者为了降低模型整体准确率,故意提交与真实梯度方向相反的更新。

- 针对性的后门:精心构造的更新,旨在让模型在特定输入上产生错误输出,而在其他数据上表现正常,极难察觉。

注意:这里我们讨论的“恶意”是广义的,它既包括主动攻击,也包括因极端硬件缺陷导致的、表现类似恶意的非确定性故障。

为什么传统的均值聚合(如FedAvg)在这里会失效?假设我们有10个节点,其中2个是拜占庭节点。在均值聚合下,这两个恶意节点提交的极大值会直接拉高整体更新的幅度和方向,导致服务器聚合后的更新严重偏离正确轨道。模型不仅无法收敛,甚至可能“学坏”。下表对比了几种常见聚合策略在拜占庭场景下的脆弱性:

| 简单平均 (FedAvg) | 对所有客户端梯度取算术平均。 | 极低。少数恶意梯度能显著影响均值。 | 可信、同质化环境下的联邦学习。 |

| 中位数/坐标中位数 | 对每个维度独立取所有客户端梯度的中位数。 | 中等。能容忍接近一半的恶意值,但维度间关联性被忽略。 | 对异常值有一定抵抗需求的场景。 |

| 裁剪平均 | 先将梯度裁剪到一定范数内,再取平均。 | 有限。仅能限制单次更新的破坏幅度,无法纠正方向错误。 | 防御显着的梯度爆炸或轻微扰动。 |

| Krum / Multi-Krum | 基于梯度间的相互距离,筛选出最“一致”的子集进行聚合。 | 高。其理论保证能在一定比例的恶意节点下收敛。 | 对安全性要求高、存在不可信节点的分布式训练。 |

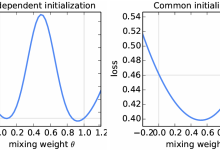

Krum算法的核心思想非常直观:“群众的眼睛是雪亮的”。它不信任任何一个节点单独提交的更新,而是通过考察所有更新之间的“亲密关系”,找出那个与大多数“好节点”最为一致的更新(或一组更新)。这个过程中,那些特立独行、与群体格格不入的恶意更新,自然会被排除在聚合范围之外。

2. Krum算法核心:从理论到直观理解

官方论文中的数学定义可能让人望而生畏,但我们不妨用更接地气的方式来拆解它。假设在一次训练轮次中,服务器收到了 n 个客户端发来的梯度向量 g1, g2,

网硕互联帮助中心

网硕互联帮助中心

评论前必须登录!

注册