这几年,3D 工业视觉走得很快,也走得有点累。

参数一路狂飙:像素更高、帧率更快、功率更猛、视角更广、体积更小。单看规格表,很难不让人兴奋。但真正把设备装上产线的人,往往会在几周后露出一种复杂的表情——系统确实更“强”了,可现场并没有因此变得更“简单”。

目录

一、当“看得更清楚”不再等于“问题被解决”

二、真正拉开差距的,是算法能否“吃得下现实世界”

三、同一时间,学术界在走一条看似相反、实则一致的路

四、从单点性能,走向系统协同

五、全链路能力,正在成为真正的分水岭

六、不是洗牌,而是能力开始兑现

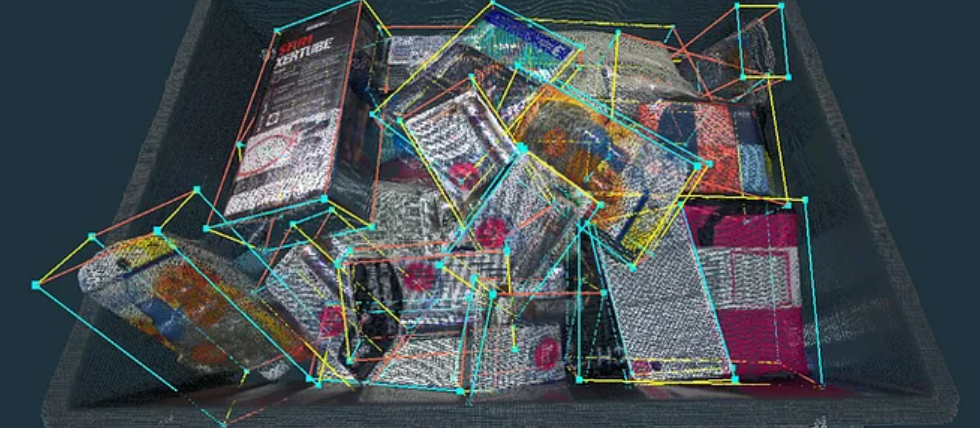

反光的金属依旧刺眼,深色材质还是难拍,乱堆料一上来,点云开始发虚。问题不但没消失,反而因为节拍更快、工况更复杂,被放大得更加明显。

行业正在经历一个不太舒服的时刻:

硬件已经卷到极限了,可真正的差距,好像不在这里。

一、当“看得更清楚”不再等于“问题被解决”

说起来,3D 视觉这条路,最早并不是这样走的。

在很长一段时间里,大家默认一个逻辑:

只要像素够高、光打得够强、帧率够快,问题总能被“拍清楚”。

这个逻辑在实验环境里成立,在标准工件、固定治具下也很少翻车。但一旦进入真实工厂,它开始变得不那么可靠。

-

反光不是均匀反光,而是随角度跳变;

-

暗色不是单纯变暗,而是边界直接消失;

-

柔性工位不是偶尔变化,而是持续变化。

于是出现了一种略显尴尬的现象:

设备拍到了更多信息,但系统却更难稳定地“理解”这些信息。

这时候再往硬件上堆,收益开始明显变薄。

二、真正拉开差距的,是算法能否“吃得下现实世界”

慢慢地,行业里的共识开始发生转移。

决定系统成败的,不是多出来的几个像素,而是算法在复杂输入下能否保持判断力;

也不是单次测试有多准,而是连续运行一个月后,状态是否依然稳定。

这背后,其实是一个更深层的问题:

算法面对的,是一个被精心整理过的世界,还是一个真实、混乱、不可预测的世界?

当柔性制造成为常态,多 SKU、随机姿态、复杂材质、工位频繁切换叠加在一起,视觉系统已经不再只是“采集工具”,而是被推上了“空间理解底座”的位置。

这一步跨不过去,参数再好看,也只能停留在展示层。

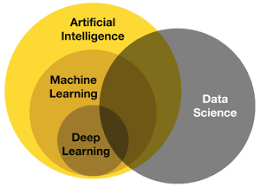

三、同一时间,学术界在走一条看似相反、实则一致的路

有意思的是,类似的转向,也正在学术界发生。

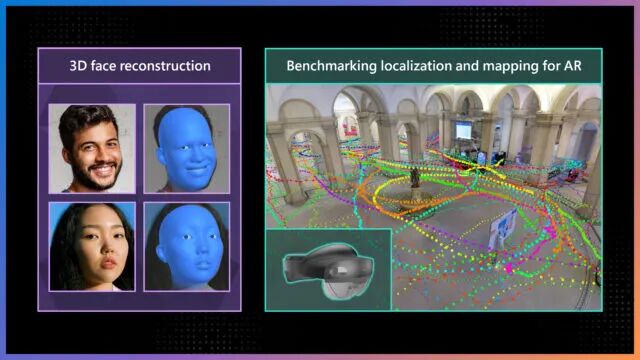

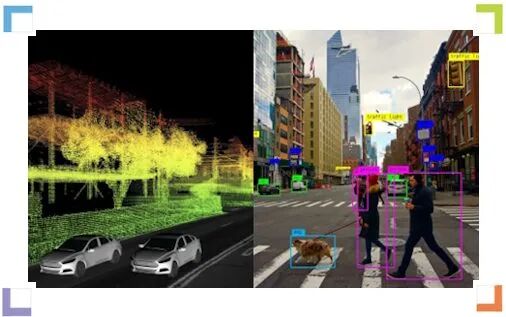

在自动驾驶和机器人领域,研究者开始反复挑战一个看似激进的问题:真的需要这么多传感器吗?

激光雷达、毫米波雷达、摄像头层层叠加,确实安全,但成本、功耗、维护复杂度同样叠加。于是,一条“减法路线”逐渐清晰——尝试仅依赖视觉,甚至只用 360° 环视摄像头,去完成 3D 环境理解。

这并不是退而求其次,而是一次难度极高的正面进攻。

单纯的视觉缺乏直接深度,算法必须真正理解几何、运动和语义,才能补足信息缺口。

把这条路线放回工业场景,其实会发现一个共通点:

行业不再指望硬件替系统兜底,而是要求系统自己具备理解能力。

四、从单点性能,走向系统协同

也正是在这样的背景下,“系统协同”开始被反复提起。

一套 3D 工业视觉系统,很少只由一个模型决定成败。

光机稳定性、成像一致性、标定精度、重建算法、平台工具链,任何一个环节波动,都会被算法成倍放大。

这也是为什么,越来越多客户开始关注一个问题:

系统是不是为算法而设计,而不是算法被迫去适配硬件。

当输入源不稳定,算法再聪明也只能疲于修补;

当成像行为批次不一致,模型泛化就无从谈起。

五、全链路能力,正在成为真正的分水岭

站在 2026 年这个时间点回看,行业的分化逻辑已经相当清晰。

未来的竞争,不会只围绕“谁的参数更高”,而是围绕:谁能在复杂工况下,长期、稳定地输出可用的三维信息;

谁能把光机、成像、重建、算法和平台,拧成一条真正协同的链路。

这也是为什么,具备全链路掌控能力的企业开始显露出结构性优势。

在算法被持续放大的时代,

-

可控、可预测的输入源本身就是壁垒;

-

稳定、一致的成像链路,本身就是算法的放大器;

-

而平台化的软件能力,决定了系统能走多远。

当 3D 工业视觉系统被推向“长期稳定运行”的要求时,问题已经不再是有没有模型,而是:模型是否被放在了一条可控、可复现、可迭代的系统链路里。

Coovally 正是沿着这条思路构建的。

它并不试图用某一个“更强”的模型去覆盖所有复杂工况,而是把重点放在如何让算法持续吃得下真实世界:

从数据处理开始,到模型训练、评估、版本管理,再到边缘端部署,所有环节被纳入同一套平台体系中,输入来源、实验条件和输出结果都可以被清晰追溯。

在实际项目中,这种能力的价值往往体现在细节里——当成像条件发生变化,模型效果波动时,工程团队能迅速定位问题究竟出在数据、训练策略,还是部署环境;当工况升级、多 SKU 并行成为常态,模型不需要“推倒重来”,而是沿着已有链路继续演进。

如果你已经有明确的工业场景,正在评估如何把视觉算法真正用进生产流程中,也可以通过下方二维码联系 Coovally。

点击阅读原文,即可体验Coovally平台!

我们更关注的,不是给你一套现成模型,而是一起把你的场景拆解成一条可长期运行的系统方案。

六、不是洗牌,而是能力开始兑现

所以,与其说 2026 年是一次行业洗牌,不如说是一轮能力兑现。

过去几年被反复验证、却不够“好讲故事”的系统能力,正在被现实场景逐一放大;

而单纯依赖硬件参数领先的优势,开始变得脆弱。

3D 工业视觉真正的时代,或许才刚刚进入正题。

它不再奖励最激进的参数,而更偏爱那些在混乱中依然能保持秩序的系统。

站在这个节点上再回头看,会发现方向其实已经很明确了。

网硕互联帮助中心

网硕互联帮助中心

评论前必须登录!

注册