目录标题

- ✅ **一、dentry 高的危害(Denrty Cache 过大意味着什么)**

-

-

- **当 dentry 数量异常增大时,会出现:**

- 1. **占用大量内存(Dentry Cache)**

- 2. **内存压力导致 "cache thrashing"**

- 3. **影响文件系统性能**

- 4. **可能导致 OOM(极端情况下)**

-

- ✅ **二、超过多少 dentry 才叫异常?**

-

- ❗ **判断标准(实战经验值)**

-

- **1. dentry > 总内存的 10%**

- **2. dentry > 总内存的 20%**

- **3. dentry > 总内存的 30%**

- 🔍 **三、如何诊断是谁导致 dentry 暴增?**

-

-

- 1. 查看 dentry 的数量与大小

- 2. 找出哪些路径被频繁访问

- 3. 找出创建/删除小文件最多的目录

- 4. k8s 环境常见原因

-

- 🔧 **四、如何处理 dentry 偏高?(从轻到重)**

-

- **方案 A:手动回收 dentry(临时措施)**

- **方案 B:调整 `vm.vfs_cache_pressure`**

- **方案 C:清理问题目录(根本解决)**

- **方案 D:文件系统层优化**

- **方案 E:重启导致问题的服务**

- ⭐ 生产经验总结(非常关键)

- 📌 需要我帮你分析你服务器的 dentry 是否异常吗?

- ✅ **一、你的 dentry 实际占了多少内存?(计算)**

-

-

- 📌 **drop 之前:**

- 📌 **drop 之后:**

-

- 🚨 **二、你的 dentry 是否异常?**

-

-

- ✔ dentry 占比(清理前)

- ✔ dentry 占比(清理后)

-

- 🎯 **结论:你的 dentry 并不高,完全不异常。**

- ❓那为什么 drop 后 buff/cache 从 34G → 5.9G?

- ❓那为什么 dentry 清理后,buff/cache 下降到了 5.9G?

- 📌 **三、你的系统状态分析(非常重要)**

- 🟢 **四、你是否需要进一步处理?**

- 🧭 五、你现在应该关注的点

- 🧩 如果你想进一步检查问题根因

下面给你一份DBA/运维级别、生产实践向的完整答案,包含:

- dentry 高的危害

- 超过多少算异常(可量化判断)

- 如何诊断

- 如何处理与优化

- 如何预防

✅ 一、dentry 高的危害(Denrty Cache 过大意味着什么)

dentry(directory entry)是 Linux VFS 的目录项缓存,用来加速路径解析。正常情况下 dentry 会随着访问自动增长,并根据内核策略回收。

当 dentry 数量异常增大时,会出现:

1. 占用大量内存(Dentry Cache)

- dentry 占用 page cache + slab 内存

- 可能导致系统可用内存下降

- 进而触发 kswapd 大量 CPU 消耗, 出现高 I/O wait

2. 内存压力导致 “cache thrashing”

高 dentry 会被频繁回收,新请求又产生大量 dentry ——> CPU 像扫地一样,无效循环。

3. 影响文件系统性能

- stat(), open() 等系统调用变慢

- 对大量小文件的应用(比如 MySQL、Nginx 日志、k8s 组件)影响明显

- 若 inode/dentry 太多,ext4 / xfs 会出现延迟异常

4. 可能导致 OOM(极端情况下)

如果 dentry 占用内存过多导致 free memory 太小,内核会优先杀进程。

✅ 二、超过多少 dentry 才叫异常?

先看当前系统的 dentry 使用情况:

cat /proc/slabinfo | grep -i dentry

或:

slabtop -o | more

关键指标是 dentry 的总占用内存。

❗ 判断标准(实战经验值)

1. dentry > 总内存的 10%

需要关注, 但可能正常(例如大量小文件的应用)

2. dentry > 总内存的 20%

属于异常偏高,需要排查 一般表现为:

- free 内存低

- kswapd 变高

- 系统延迟增大

3. dentry > 总内存的 30%

必定要处理,通常意味着:

- 某程序疯狂扫描目录或创建大量小文件

- 某些 Docker/k8s workload 在不断创建临时文件

- 线上 I/O 延迟已经异常

🔍 三、如何诊断是谁导致 dentry 暴增?

1. 查看 dentry 的数量与大小

grep -i dentry /proc/slabinfo

字段解释:

- active_objs — 活动对象数量

- objsize — 单个对象大小

- active_slabs * objs_per_slab * objsize → 计算总内存占用

2. 找出哪些路径被频繁访问

安装 eBPF 工具(推荐):

yum install bcc-tools -y

opensnoop-bpfcc

可抓取对路径的频繁 open(),定位进程。

3. 找出创建/删除小文件最多的目录

du -ah / | sort -h | tail

或使用 inode 数量:

find / -xdev -printf "%h\\n" | sort | uniq -c | sort -n | tail

4. k8s 环境常见原因

- container logs 目录增长过快: /var/lib/docker/containers/*/*.log

- kubelet 的 pods 临时目录: /var/lib/kubelet/pods/UUID/volumes/…

- 容器运行时清理策略失效

🔧 四、如何处理 dentry 偏高?(从轻到重)

方案 A:手动回收 dentry(临时措施)

echo 2 > /proc/sys/vm/drop_caches

含义:

| 1 | 清 page cache |

| 2 | 清 dentry + inode |

| 3 | 清 page + inode + dentry |

⚠️ 不影响业务运行,但会导致短暂性能波动 ⚠️ 这只是缓解,不是根本解决

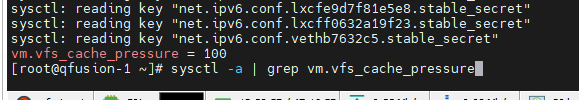

方案 B:调整 vm.vfs_cache_pressure

调整回收力度:

sysctl -w vm.vfs_cache_pressure=200

默认 100,一般生产建议:

- 重压力系统:200~300

- 小文件极多服务器(比如 gitlab):50

写入永久:

echo "vm.vfs_cache_pressure=200" >> /etc/sysctl.conf

方案 C:清理问题目录(根本解决)

例如:

find /var/log/ -type f -size +500M -delete

清理 Docker/k8s 产生的小文件:

docker system prune -af

k8s logs:

/var/log/containers/*.log

若通过 eBPF 发现某个应用疯狂遍历目录,需要优化程序逻辑。

方案 D:文件系统层优化

方案 E:重启导致问题的服务

常见导致不断扫描目录的程序:

- rsync

- prometheus node-exporter

- 某些安全软件

- 文件监控 agent

- 应用错误逻辑(死循环扫描目录)

⭐ 生产经验总结(非常关键)

| <10% | 正常 | 无需处理 |

| 10–20% | 偏高 | 建议观察并找原因 |

| 20–30% | 异常 | 立刻排查程序问题 |

| >30% | 严重 | 清 cache + 找源头 |

📌 需要我帮你分析你服务器的 dentry 是否异常吗?

如果你能贴:

cat /proc/slabinfo | grep dentry

free -m

slabtop -sc

我可以帮你:

- 计算当前 dentry 内存占比

- 判断是否异常

- 定位可能的根因目录/进程

- 给出具体清理与优化建议

测试环境验证

✅ 一、你的 dentry 实际占了多少内存?(计算)

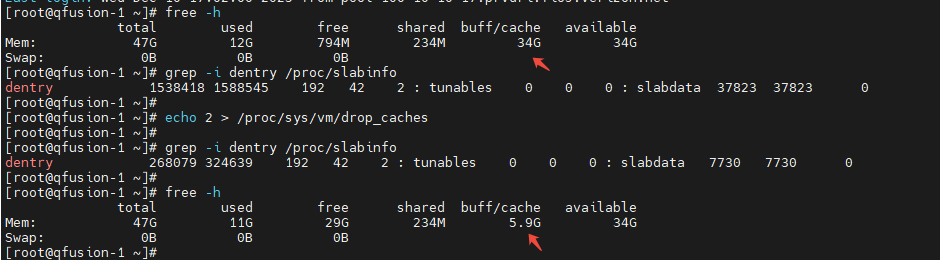

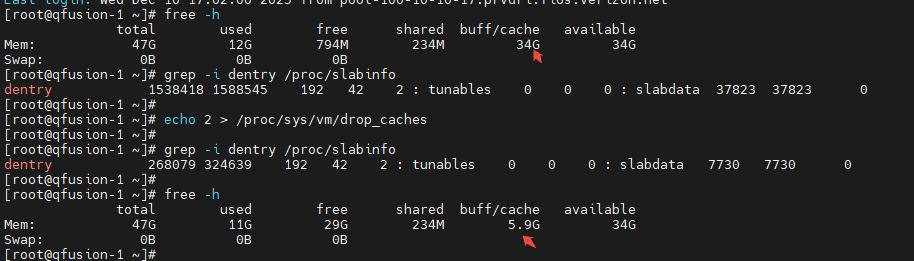

📌 drop 之前:

dentry active_objs: 1538418

each obj size: 192 bytes

计算:

1538418 × 192 = 295,373,000 bytes ≈ 282 MB

≈ 280MB dentry

📌 drop 之后:

268079 × 192 = 51,473,000 bytes ≈ 49 MB

≈ 50MB dentry

🚨 二、你的 dentry 是否异常?

你的服务器内存:47G

✔ dentry 占比(清理前)

280 MB / 47 GB ≈ 0.6%

✔ dentry 占比(清理后)

50 MB / 47 GB ≈ 0.1%

🎯 结论:你的 dentry 并不高,完全不异常。

正常范围:

- <10% → 完全正常

-

20% → 应关注

-

30% → 必须处理

你只有 0.6%,远远不构成压力。

❓那为什么 drop 后 buff/cache 从 34G → 5.9G?

因为:

echo 2 > /proc/sys/vm/drop_caches

会清理 dentry + inode,这些都存放在 SLAB,但也会波及到 page cache(目录读取、文件读取都带 page cache)。

你的系统之前的 buff/cache(34G)包含内容:

- dentry + inode(占非常少)

- page cache(绝大部分)

- 文件系统元数据 cache

- 其他 slab

drop_caches = 2 实际上会清掉 slab 中的大部分可回收 cache → 所以 buff/cache 大幅下降是 正常现象。

不是你的 dentry 特别高,而是系统的 page cache 原本就很大(这也正常)。

❓那为什么 dentry 清理后,buff/cache 下降到了 5.9G?

因为:

dentry 只是 slab 的一小部分 slab 又只是 buff/cache 的一小部分 buff/cache 还包含大量 page cache

你 drop 后,系统把 page cache 也顺便 drop 掉了。

📌 三、你的系统状态分析(非常重要)

根据 free:

used 12G → 11G

free 0.8G → 29G

buff/cache 34G → 5.9G

说明:

- 内存富足

- page cache 很多(正常,因为 Linux 会用空闲内存来做 cache)

- dentry 并不高

- 没有内存压力

- 没有必要 drop cache

- drop 之后反而让 Linux 重新加载 cache,可能稍微影响性能

🟢 四、你是否需要进一步处理?

不需要。完全不需要。

你的 dentry:

- 原本就只有 280MB

- 清除后恢复到正常值(几百 MB → 数十 MB 都属于正常波动)

- 内存宽裕

- 系统非常健康

🧭 五、你现在应该关注的点

✔ 你的系统根本不是 dentry 占用过高 ✔ 你清理 dentry 后出现 buff/cache 大降是正常现象 ✔ 随便 drop cache 并不是好习惯,会影响业务性能

🧩 如果你想进一步检查问题根因

我可以帮你确认:

- 哪些 slab 占用最多?

- page cache 是否异常大?

- 哪个目录文件特别多?

- 哪个程序频繁访问文件系统?

你可以给我:

slabtop -sc

du -sh /*

我可以帮你点出占用最大的部分,并判断是否存在问题。

如需要继续,直接贴输出即可。

网硕互联帮助中心

网硕互联帮助中心

评论前必须登录!

注册