文章目录

-

-

- 技术栈选择

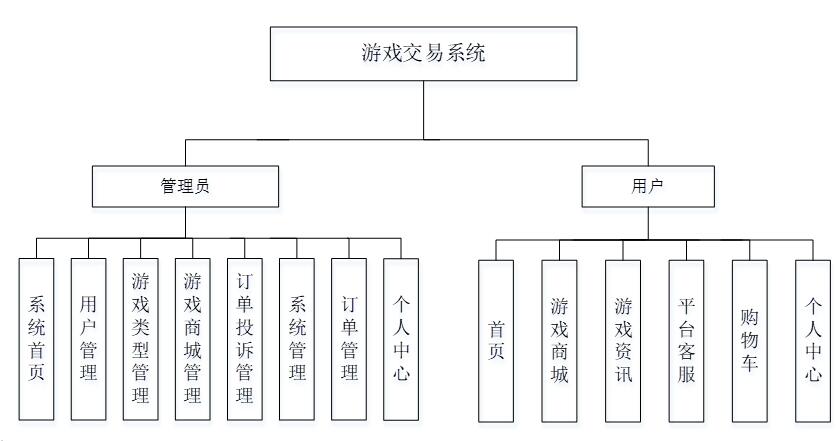

- 系统架构设计

- 核心功能模块

- 数据库设计

- 关键代码示例

- 安全与性能优化

- 测试与部署

- 扩展性考虑

- 大数据系统开发流程

- 主要运用技术介绍

- 源码文档获取定制开发/同行可拿货,招校园代理 :文章底部获取博主联系方式!

-

技术栈选择

Python后端采用Django或FastAPI框架,提供RESTful API接口;Vue 3作为前端框架,Element Plus或Ant Design Vue作为UI组件库;数据库使用MySQL或PostgreSQL;Redis用于缓存和会话管理。

系统架构设计

采用前后端分离架构,前端通过Axios与后端交互。后端分为控制层、服务层、数据访问层,实现高内聚低耦合。Nginx作为反向代理服务器,部署前端静态资源并转发API请求。

核心功能模块

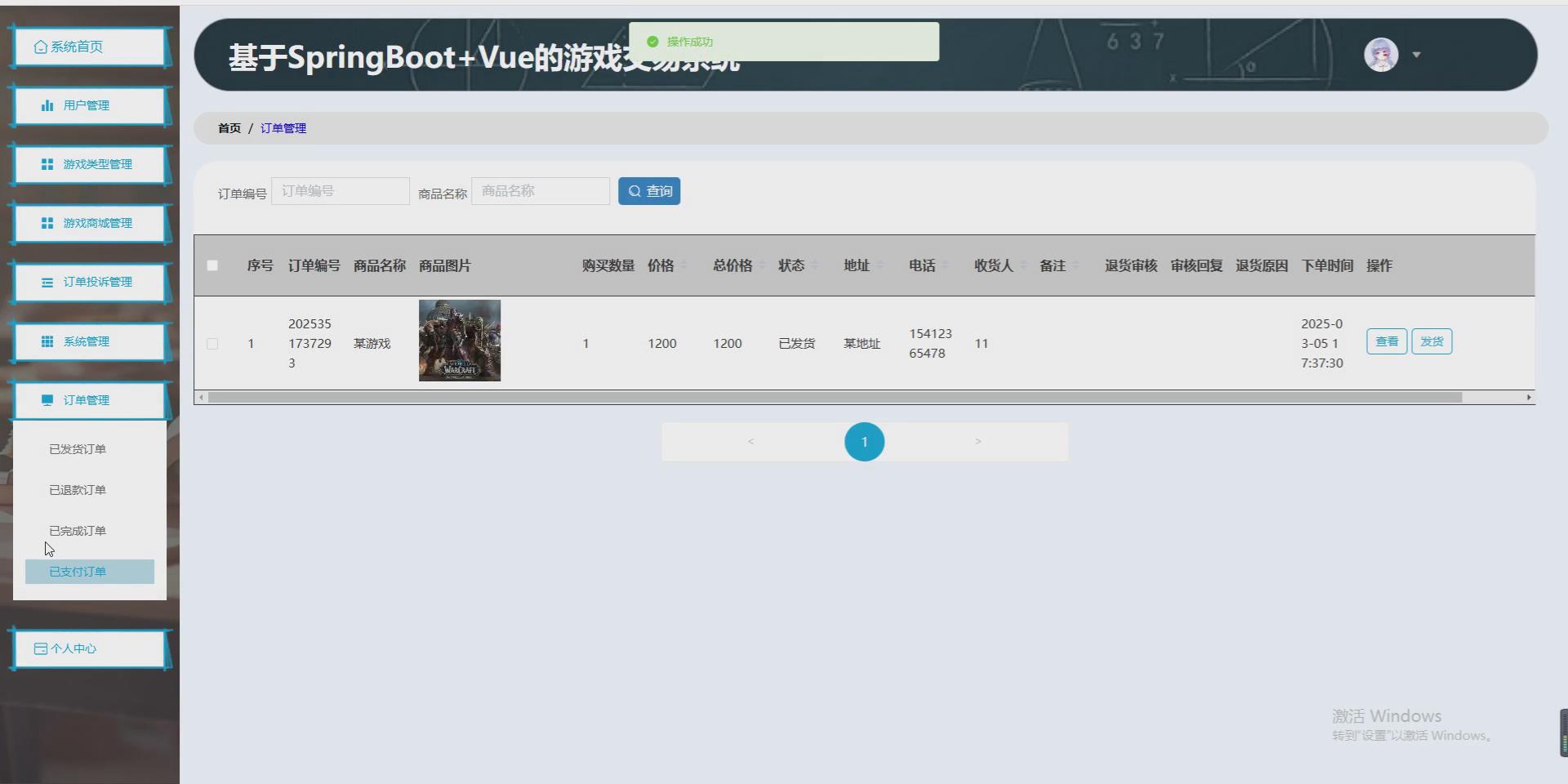

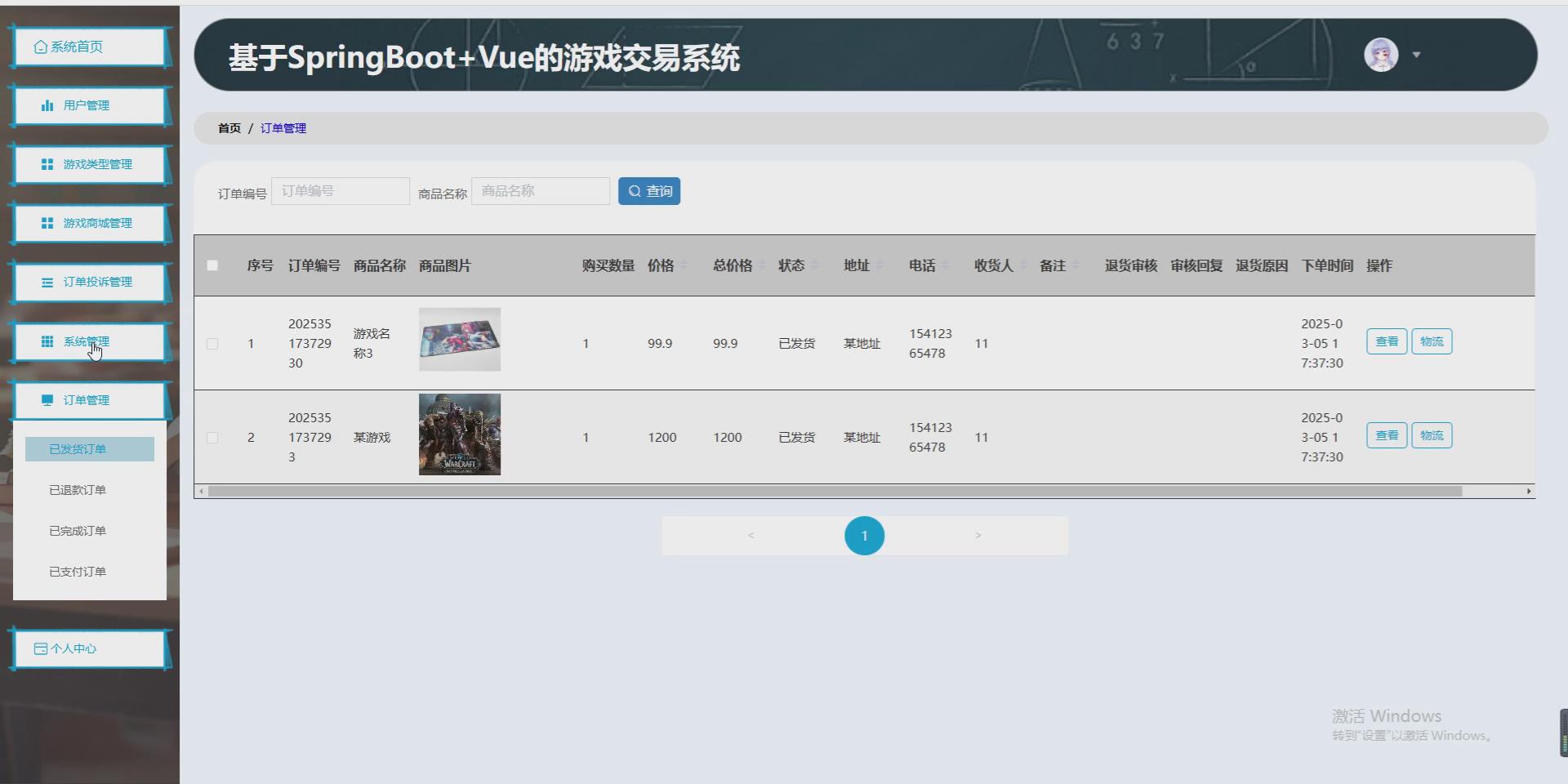

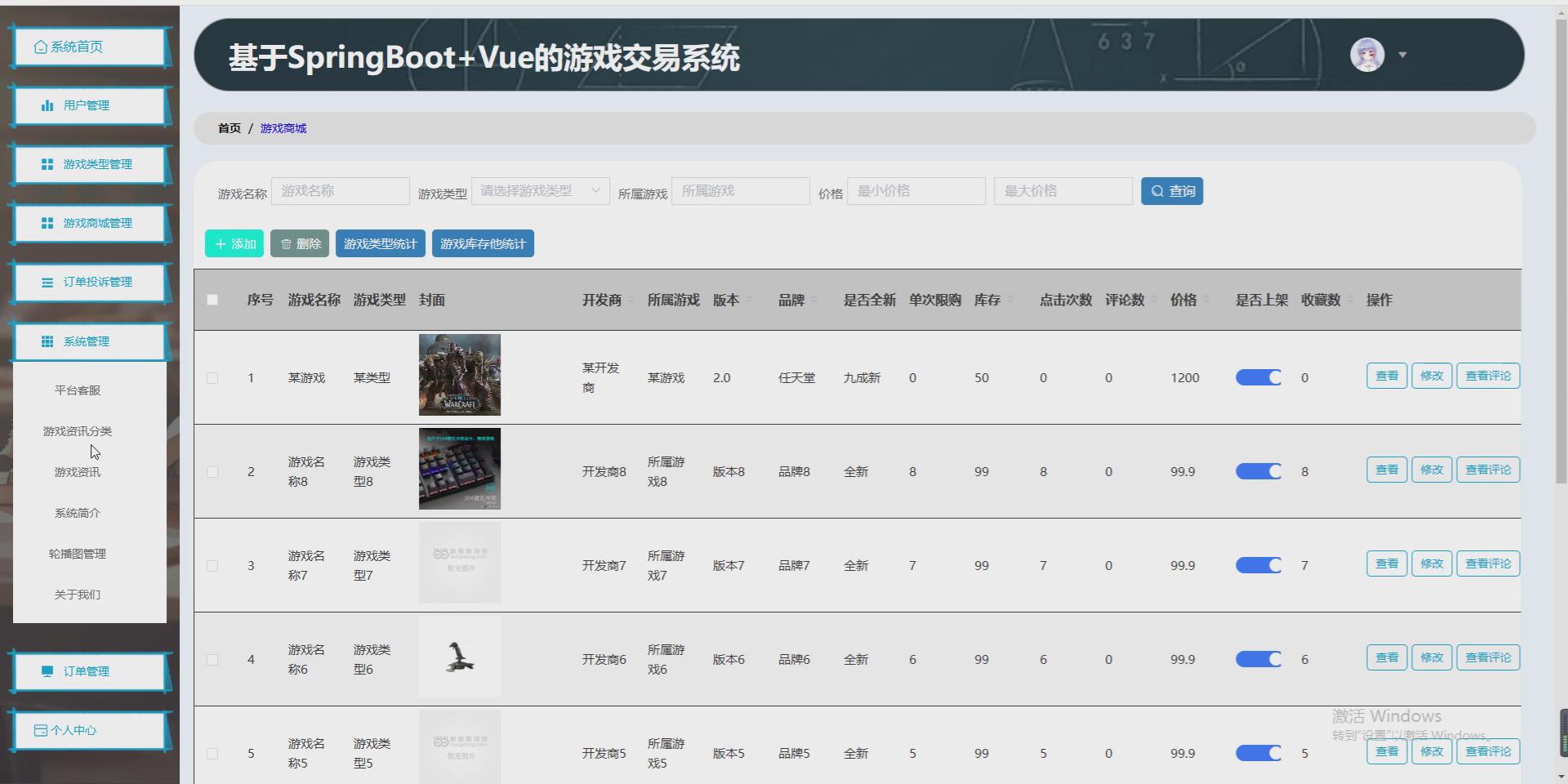

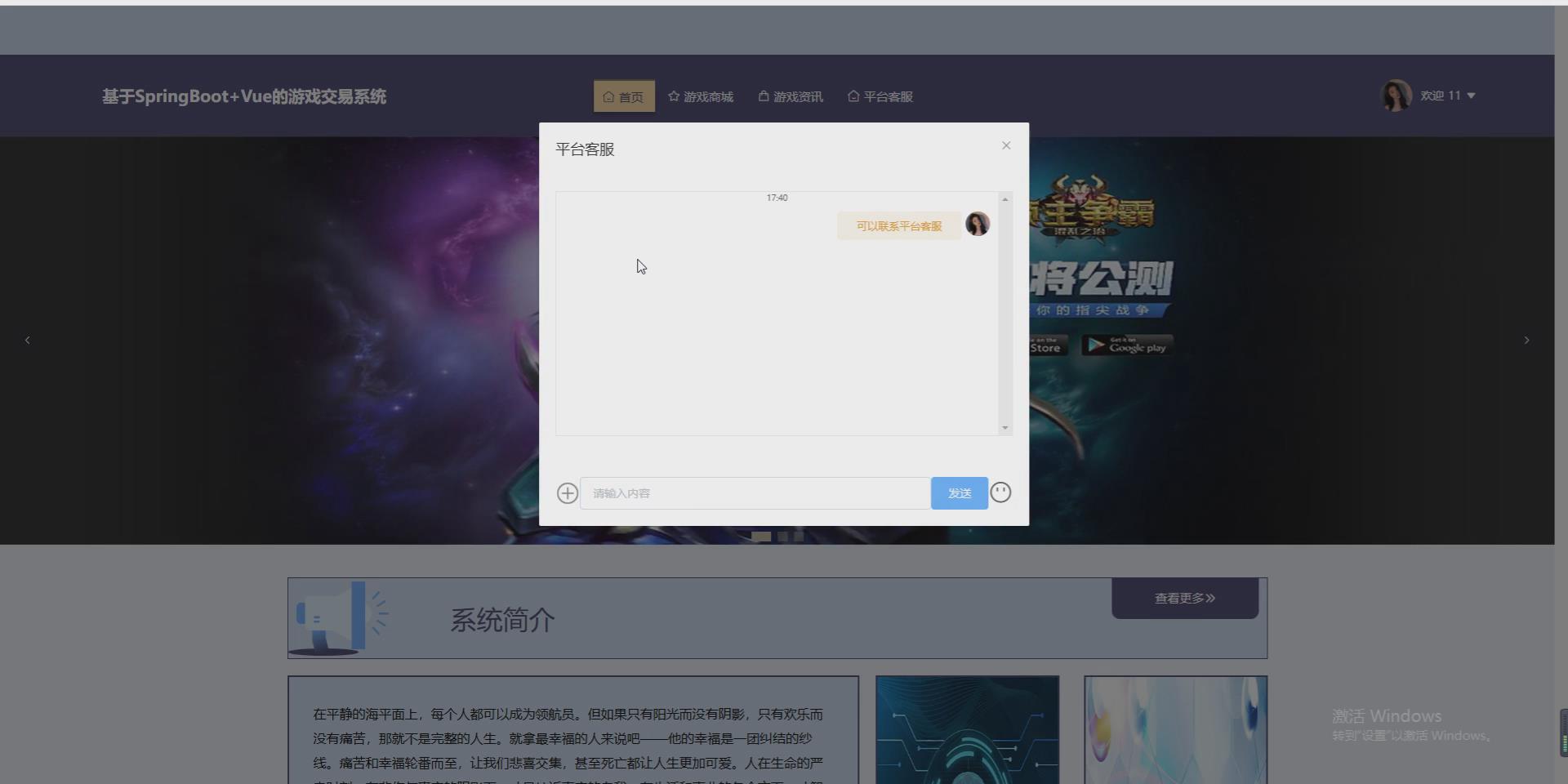

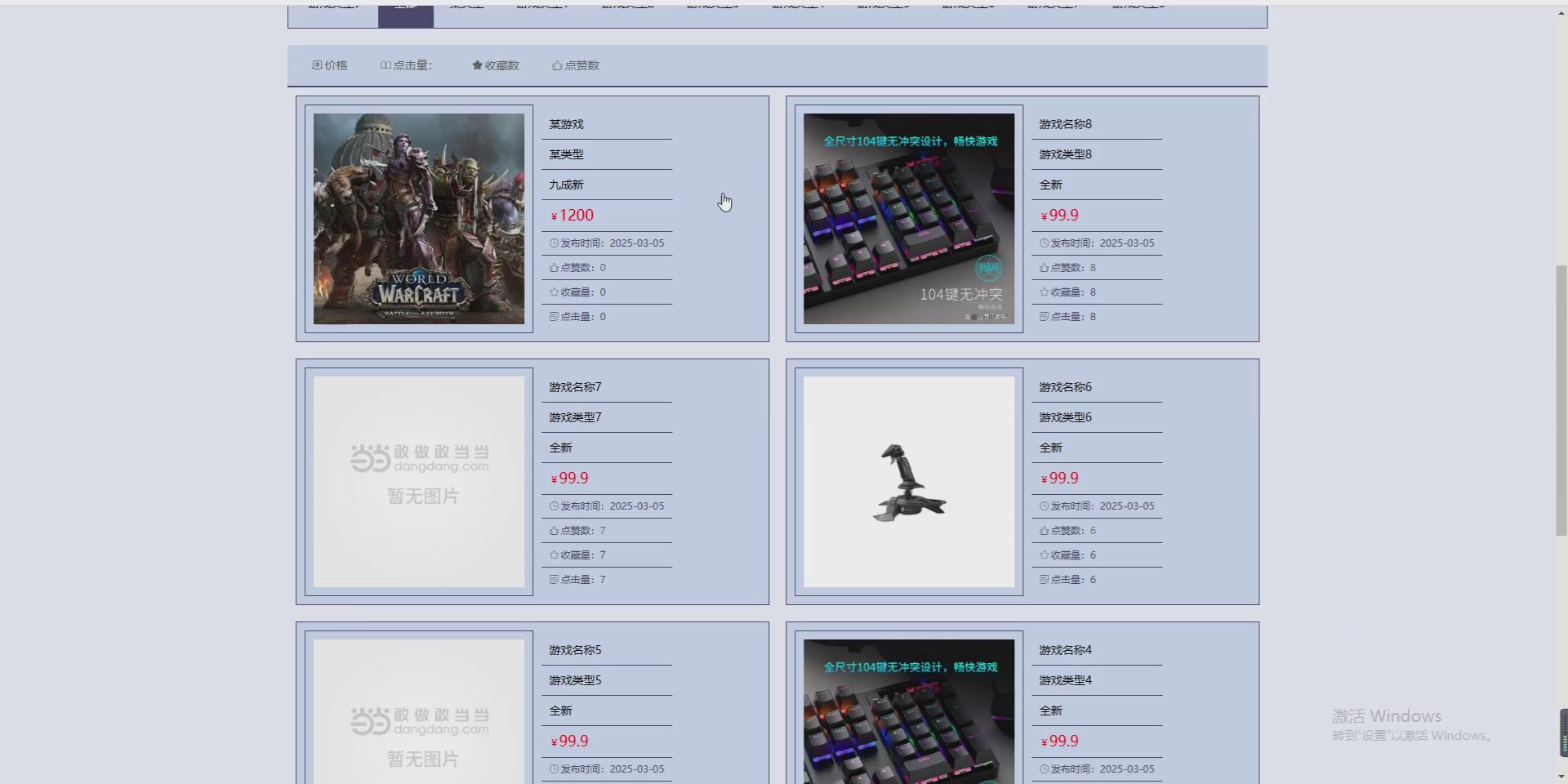

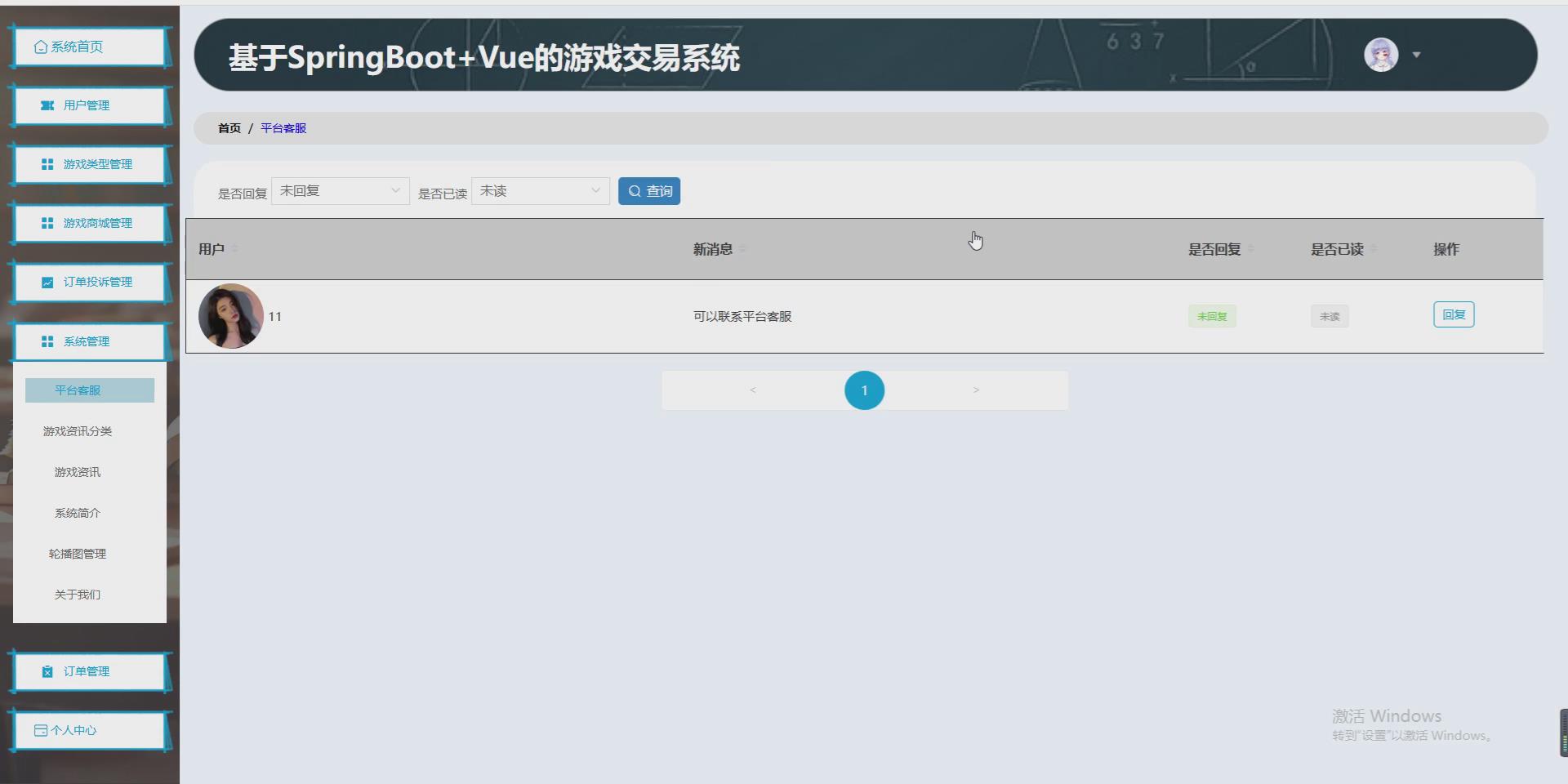

用户模块:注册/登录(JWT认证)、个人信息管理、实名认证。 商品模块:装备分类展示、搜索筛选、详情页(图片轮播、属性展示)。 交易模块:购物车、订单创建、支付接口集成(支付宝/微信沙箱)。 后台管理:商品上下架、订单审核、数据统计看板。

数据库设计

用户表(user_info)、商品表(product)、订单表(order)、支付记录表(payment)。建立外键关联,如订单表关联用户ID和商品ID。索引优化高频查询字段。

关键代码示例

后端订单创建接口(FastAPI):

@app.post("/orders/")

async def create_order(order_data: OrderSchema, token: str = Depends(oauth2_scheme)):

user = authenticate_user(token)

db_order = Order(**order_data.dict(), user_id=user.id)

db.add(db_order)

db.commit()

return {"order_id": db_order.id}

前端商品列表组件(Vue):

<template>

<el-table :data="equipmentList">

<el-table-column prop="name" label="装备名称"/>

<el-table-column prop="price" label="价格"/>

</el-table>

</template>

<script setup>

const equipmentList = ref([]);

axios.get('/api/products').then(res => {

equipmentList.value = res.data;

});

</script>

安全与性能优化

接口添加速率限制(如Redis计数器),敏感数据加密存储(AES算法),CSRF防护。前端路由守卫验证登录状态,图片懒加载减少首屏加载时间。

测试与部署

使用PyTest进行单元测试,Postman测试API完整性。Docker容器化部署,GitHub Actions实现CI/CD流水线。监控采用Prometheus+Grafana。

扩展性考虑

预留WebSocket接口用于实时交易通知,微服务化拆分支付模块,支持后期引入推荐算法(协同过滤)。

大数据系统开发流程

Python版本:python3.7+ 前端:vue.js+elementui 框架:django/flask都有,都支持 后端:python 数据库:mysql 数据库工具:Navicat 开发软件:PyCharm

Scrapy作为高性能的网络爬虫框架,负责从各类目标网站上抓取数据,为系统提供丰富的数据源。Pandas则用于数据的清洗、整理和分析,它能够处理复杂的数据操作,确保数据的准确性和可靠性。在数据可视化方面,Echarts和Vue.js发挥重要作用。Echarts提供直观、生动、可交互的数据可视化图表,帮助用户更好地理解数据背后的价值;Vue.js作为一种流行的前端开发框架,为数据可视化提供了强大的支持,使界面更加友好和易用。Flask框架和django框架用于搭建系统的后端服务,提供基本的路由、模板和静态文件服务功能。MySQL数据库则用于存储和管理从爬虫获取的数据、用户信息以及分析结果等,为系统提供高效的数据存储和查询能力。 爬虫原理 基本上所有Python爬虫初学者都会接触到两个工具库,requests和BeautifulSoup,这二者作为最为常见的基础库,其使用方式也截然不同,其中request工具库主要是用来获取网页的源代码,其需要向服务器发送url请求指令;而beautifulsoup则主要用来对网页的源语言,包括且不限于HTML\\xml进行读取和解析,提取重要信息。这两个库模拟了人们访问网页、阅读网页以及复制粘贴相应信息的过程,可以批量快速抓取数据。 数据清洗 数据清洗技术主要是通过使用python语言中的正则表达式技术,通过其大量收集目标数据,并进一步进行提取。2、数据转换技术主要是通过加载法,将源数据中收集到的字符串按照相应的规则和序列转换成字典。3、数据去重即用unique方法,返回没有重复元素的数组或列表。 预处理后保存到CSV文件中。 数据挖掘 数据挖掘主要是通过运用设计好的算法对已有的数据进行分析和汇总,并按照数据的特征进行情感分析。统计数据过程中多使用snownlp类库来实现这一基本的情感分析的操作,通过计算弹幕的数据值,来分析其中的倾向性。情感分析中长用sentiment来指明实际的情感值。其中,数据一旦越靠近1则越表明其正面属性,越接近0越负面,相关的结果数据可以作为情感分析的基础数据而得到。 数据可视化大屏分析 数据可视化模块主要采用饼图、词云和折线图等手段来实现最终的数据可视化。并通过matplotlib库等技术来进一步地研究和分析数据的特点,最终通过图表的模式来展示数据的深层含义。可视化模块包括各时段视频播放量比例图、热词统计图、每周不同时间视频播放量线图、情绪比例图等可视化图形。

主要运用技术介绍

Python语言 Python 是一个高层次的结合了解释性、编译性、互动性和面向对象的脚本语言,其设计具有很强的可读性,相比其他语言经常使用英文关键字,其他语言的一些标点符号,它具有比其他语言更有特色语法结构。 Flask框架 Flask 是一个轻量级的 Web 框架,使用 Python 语言编写,较其他同类型框架更为灵活、轻便且容易上手,小型团队在短时间内就可以完成功能丰富的中小型网站或 Web 服务的实现。 Flask 具有很强的定制性,用户可以根据自己的需求来添加相应的功能,在保持核心功能简单的同时实现功能的丰富与扩展,其强大的插件库可以让用户实现个性化的网站定制,开发出功能强大的网站。 Djiango框架

源码文档获取定制开发/同行可拿货,招校园代理 :文章底部获取博主联系方式!

需要成品或者定制,加我们的时候,不满意的可以定制 文章最下方名片联系我即可~ 所有项目都经过测试完善,本系统包修改时间和标题,包安装部署运行调试

网硕互联帮助中心

网硕互联帮助中心

评论前必须登录!

注册