AI服务器液冷实战:从NVIDIA H100到国产GPU的散热方案对比

当NVIDIA H100的TDP突破700W大关,国产GPU加速卡如天数智芯BI/V系列也迈入300W+功耗区间时,传统风冷散热已显疲态。某头部云服务商的实际测试数据显示,在同等算力负载下,采用冷板式液冷的H100集群相比风冷方案可降低芯片结温28℃,同时减少37%的散热能耗。这不禁让人思考:面对AI训练与推理场景中持续攀升的算力密度,液冷技术究竟能带来哪些实质性突破?不同技术路线又该如何适配多元化的硬件生态?

1. 液冷技术为何成为AI时代的刚需

在千卡级AI训练集群中,单机柜功率密度正以每年15-20%的速度递增。2024年行业调研数据显示,主流AI服务器的平均功耗已达8-12kW/机柜,部分高密度部署场景甚至突破30kW。传统风冷系统在此类环境下暴露出三大致命短板:

- 热传导效率瓶颈:空气导热系数仅0.024W/(m·K),而水的导热系数高达0.6W/(m·K),这意味着液体介质的单位时间传热量可达空气的25倍

- 能耗比恶化:风扇系统功耗占比随功率密度飙升,50kW机柜中风冷系统的PUE普遍超过1.5

- 空间利用率低下:为保障气流组织,风冷机柜通常需要预留40%以上的无效空间

某超算中心的实测案例显示,将A100集群从风冷改造为浸没式液冷后,不仅实现了1.03的极致PUE,更使单机柜算力密度提升3倍,节省机房面积达60%

液冷技术通过物理特性的根本性突破,为高密度算力提供了全新的散热范式。其核心优势可量化表现为:

| 散热能力 | ≤20kW/机柜 | 50-80kW/机柜 | 100-200kW/机柜 |

| PUE值 | 1.4-1.6 | 1.1-1.2 | 1.02-1.05 |

| 噪音水平 | 75dB以上 | 45-55dB | <30dB |

| 芯片温差(ΔT) | 15-25℃ | 5-8℃ | 2-3℃ |

2. 主流液冷方案的技术解剖

2.1 冷板式液冷:平衡之选

冷板式液冷采用模块化设计,其核心是在GPU/CPU等高温器件表面安装微通道金属冷板。以NVIDIA HGX A100液冷参考设计为例:

# 典型冷板流道设计参数示例

flow_rate = 4.5 # L/min

inlet_temp = 45 # ℃

delta_p = 1.2 # bar

heat_removal = 700 # W/cm²

该方案的关键创新点包括:

- 歧管快拆技术:Stäubli公司的MX系列接头支持5000次热插拔,泄漏率<1滴/年

- 梯度流道设计:通过变截面流道优化,使H100 GPU的芯片温差控制在5℃以内

- 智能控温系统:采用PID算法动态调节流量,响应延迟<50ms

国产方案中,华为Atlas 900 PoD液冷集群采用相变冷板技术,在2U空间内实现6颗昇腾910B处理器的均温散热,实测Tcase温度比风冷降低18℃。

2.2 浸没式液冷:极致效能

单相浸没与相变浸没构成当前两大技术分支。阿里云"麒麟"集群采用3M Novec 7100工质,其技术特征对比:

| 工质温度 | 35-50℃ | 50-60℃(沸点) |

| 换热系数(W/m²K) | 2000-3000 | 5000-10000 |

| 系统复杂度 | 中 | 高 |

| 维护便利性 | 较好 | 较差 |

某国产GPU厂商的测试数据显示,在300W TDP的BI-V100芯片上,相变浸没可使结温稳定在65℃以下,同时允许芯片超频15%而不触发降频保护。

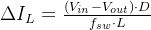

2.3 喷淋式液冷:精准控温

喷淋技术通过微米级喷嘴阵列实现定向冷却。贵州枢纽节点采用的技术方案包含:

该方案使国产GPU的有效算力从风冷时的78%提升至92%,同时芯片温度波动幅度缩小60%。

3. 典型部署场景实战分析

3.1 大规模训练集群

NVIDIA DGX SuperPOD的液冷架构包含三级散热:

# 典型运维监控命令

nvidia-smi -q -d TEMPERATURE

liquidctl status –device 0

某智算中心的实际运行数据显示,千卡H100液冷集群相比风冷方案:

- 年节电量:420万度

- 运维成本下降:35%

- GPU可用率:99.98%

3.2 边缘推理节点

针对国产GPU的边缘部署需求,定制化方案需考虑:

- 紧凑型CDU:尺寸<6U,支持-40℃~60℃环境温度

- 防冻配方:乙二醇混合液比例优化

- 快速连接器:盲插式设计,插拔力<50N

某车载AI项目的实测表明,液冷方案使BI-V20芯片在颠簸环境下温度波动<±3℃,远超风冷的±15℃。

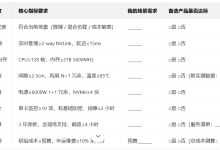

4. 选型决策矩阵与成本模型

4.1 技术适配性评估

| 改造成本 | $$ | $$$$ | $$$ |

| 兼容性 | 高(支持混部) | 低(需定制) | 中 |

| 维护复杂度 | 中 | 高 | 中 |

| 能效比 | 1.8x风冷 | 3.5x风冷 | 2.2x风冷 |

4.2 TCO对比分析

以5年周期计算100kW机柜的总体成本:

| 初投成本(万) | 120 | 180 | 250 |

| 电费(万) | 450 | 270 | 210 |

| 运维(万) | 80 | 60 | 100 |

| 总成本(万) | 650 | 510 | 560 |

注:电费按0.8元/度计算,冷板式方案的ROI周期约为2.3年

实际项目中,当机柜功率>15kW时液冷经济性开始显现,而超过30kW后浸没式方案的综合优势将愈发明显。某金融风控平台采用分级部署策略:核心训练集群用浸没式,边缘推理节点用冷板式,整体TCO降低28%。

网硕互联帮助中心

网硕互联帮助中心

评论前必须登录!

注册