AI服务器液冷实战:从NVIDIA H100到国产GPU的散热方案对比

AI服务器液冷实战:从NVIDIA H100到国产GPU的散热方案对比 当NVIDIA H100的TDP突破700W大关,国产GPU...

AI服务器液冷实战:从NVIDIA H100到国产GPU的散热方案对比 当NVIDIA H100的TDP突破700W大关,国产GPU...

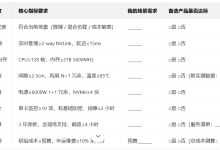

在 AI 大模型从实验室走向产业落地的 2025 年,4U8 卡 AI 服务器已然成为企业算力布局的 \"刚需装备\"。它就像 AI 时代的 \"...

在科研与工程领域,“计算能力”早已成为突破创新的核心生产力。当你在量子化学中模拟电子轨道、在分子动力学中预测蛋白结构、在工业仿真中优化风洞实验&#...

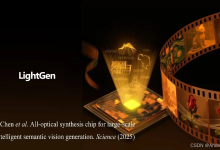

在AI大模型算力需求指数级暴涨、摩尔定律逐渐触顶的今天,传统电子芯片的高能耗、低并行瓶颈越来越突出,而光计算作为下一代算力核心技术&...

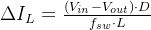

引言:当算力需求撞上物理学的墙数据中心机房的低鸣,如今已演变为AI算力洪流的咆哮。根据Synergy Research Group的...

文章浏览阅读836次,点赞11次,收藏13次。对于企业而言,如电商平台利用深度学习进行精准推荐系统的构建,GPU 服务器的强大算力能够实时处理用户的浏览和购买数...