IBM V3700存储服务器双控制器故障实战:从黄灯报警到数据恢复的全过程记录

那天下午,手机屏幕亮起,一个来自东莞某医疗机构的紧急求助。对方IT负责人语气急促,核心业务存储突然“罢工”,所有患者档案和运营数据瞬间无法访问。这不是普通的服务器宕机,而是一台承载着关键业务的IBM V3700存储阵列,两块控制器同时亮起了刺眼的黄灯。对于任何企业的IT运维团队来说,这都意味着进入了最高级别的故障应急状态。本文将抛开教科书式的理论,完全从一个实战工程师的视角,复盘这次惊心动魄的双控制器故障处理与数据恢复全过程。无论你是企业内部的IT运维骨干,还是提供技术支持的服务工程师,希望这份详尽的“战地笔记”能为你提供真正有价值的参考。

1. 故障初判:从远程诊断到现场确认

接到报修电话后,首要任务不是立刻奔赴现场,而是进行精准的远程预判。盲目上门不仅效率低下,还可能因为备件准备不足而延误黄金修复时间。我们要求客户方的IT人员协助,通过管理网络访问存储的管理IP。

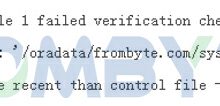

第一步是获取系统日志。 对于V3700这类企业级存储,其内部日志是诊断故障根源的“黑匣子”。我们指导客户通过命令行工具或管理GUI下载完整的系统日志包。分析日志并非漫无目的,而是有明确的搜索焦点:

- 关键错误代码:例如“Node 578”、“587”这类节点相关报错。

- 控制器状态变迁记录:重点关注控制器从“在线”变为“脱机”或“故障”的时间点及关联事件。

- 电池与缓存状态:日志中会明确记录缓存备份电池的健康状况,这是判断数据安全性的重要依据。

通过远程分析,我们迅速锁定了几个核心问题:

基于此,我们做出了初步判断:这是一起典型的双控制器硬件故障事件,可能涉及控制器主板、缓存模块或关联电源。 数据虽然暂时不可访问,但由于V3700采用镜像缓存等保护机制,只要硬盘阵列(如RAID)本身完好,数据恢复的希望非常大。我们立即准备了两块同型号的控制器备件、配套的固件版本说明以及专用的服务工具,动身前往现场。

注意:远程诊断阶段,与客户IT人员的有效沟通至关重要。清晰告知风险(如数据丢失可能性)和预期方案,能建立信任并为现场工作扫清流程障碍。

2. 备件准备与现场操作前奏

抵达客户数据中心后,我们没有急于动手拆换硬件。规范的操作流程是保障数据安全的第一道防线。我们首先进行了现场环境复查:

- 刷新到与故障存储系统完全一致的微码(固件)版本。

- 将控制器的运行模式设置为 “候选状态” 。这个状态意味着控制器已就绪,但不会主动接管业务,等待被系统识别并加入集群。

# 以下为类似存储设备预配置备件的概念性命令示意,实际操作需遵循IBM官方工具指南

# 通过服务笔记本连接备件控制器

ssh service-tool@controller-spare-ip

# 检查并更新固件版本至目标版本

check_firmware –current

install_firmware –file /path/to/v3700_v7.8.0.xx.bin

# 将控制器模式设置为候选(Candidate)

set_controller_mode –mode candidate

完成备件预配置后,我们与客户进行了最后一次简短沟通,明确了操作窗口、潜在风险(尽管已降至最低)并获得了正式的操作授权。接下来,才是真正的核心操作阶段。

3. 控制器更换与系统重识

更换硬件环节,手法必须稳、准、轻。我们按照以下顺序操作:

更换完成后,系统并不会立即恢复正常。我们需要通过服务接口(通常是控制器上的一个专用管理网口,IP如192.168.70.121)登录到存储的服务助手界面。在这里,我们需要验证两个新控制器是否都被系统正确识别并处于“待命”状态。

一个关键的检查点是查看控制器的伙伴关系和对硬盘池的识别情况。理想状态下,两个新控制器应该能互相通信,并能看到所有硬盘,但此时数据卷(LUN)很可能仍处于“脱机”或“需要恢复”的状态。因为系统知道节点曾发生过切换,它需要确保数据一致性。

4. 核心攻坚:通过T4层恢复节点与数据

这是整个恢复过程中技术含量最高、也最需要谨慎的一步。所谓“T4恢复”,指的是在存储系统的底层服务模式下,执行节点恢复操作。这个操作能引导存储系统基于硬盘上的元数据和日志,重建控制器节点的状态,并安全地挂载数据卷。

操作前,我们再次进行了数据安全确认:

- 确保所有硬盘物理状态良好,无闪烁的故障灯。

- 已对当前存储配置进行了完整的配置文件备份。

- 客户知晓此步骤是恢复数据的最终操作,并已对关键数据做了最坏的打算(尽管我们有十足把握)。

恢复操作大致流程如下:

进入高级服务模式:通过特定的串口连接或服务IP登录,进入命令行或图形化的高级诊断/服务界面。

扫描与识别:系统会扫描所有硬盘,识别出存储池(MDiskgrp)和属于该池的硬盘成员。更重要的是,它会分析硬盘上的元数据,找出最后一次“健康”的节点状态记录点。这就像是给存储系统做一次“CT扫描”,找到崩溃前最后一个正确的内存快照。

| 扫描存储池 | 确认硬盘组完整性 | 池名称、RAID级别、总容量 |

| 分析节点日志 | 定位最后有效节点状态 | 时间戳、节点号、序列号 |

| 验证数据一致性 | 检查元数据逻辑错误 | 通过/失败标志,错误详情 |

执行节点恢复:选定需要恢复的故障节点(本例中两个节点都需要),然后启动恢复流程。系统会依据找到的最后一致状态,在新控制器上重建节点信息,包括缓存映射表、卷配置信息等。这个过程可能会花费一些时间,取决于数据量的大小。

# 此为概念性命令示意,真实命令需使用IBM专用服务工具(如SSH服务命令)

# 列出可恢复的节点镜像

svctask lsnodehistory -l

# 输出示例会显示可用的历史节点状态点,包括时间和节点ID

# Node 1 Last Good State: 2023-10-27 14:30:01, Seq: 0x1234ABCD

# Node 2 Last Good State: 2023-10-27 14:29:58, Seq: 0x1234ABCC

# 针对节点1执行恢复(使用特定的序列号以确保精确还原)

svctask restorenode -node 1 -seq 0x1234ABCD

验证与挂载:恢复完成后,系统会提示节点恢复成功。此时,返回到常规管理界面,应该能看到两个控制器都显示为“在线”且“同步”状态。之前脱机的数据卷状态会变为“需要手动挂载”或直接变为“在线”。我们谨慎地选择一个非业务时间窗口,手动将数据卷挂载给前端的主机。

当主机操作系统重新识别到磁盘,并且文件系统检查(如fsck)顺利通过,所有数据完整呈现时,现场紧张的气氛才终于消散。我们随后进行了一系列的完整性抽查,随机打开几个大型文件和数据库,确认读写无误。

5. 事后复盘与长效运维建议

故障解决、数据恢复,工作只完成了一半。事后复盘是为了避免重蹈覆辙。我们与客户的IT团队一起分析了可能导致双控制器同时故障的原因:

- 电源质量:排查机房UPS和电路,发现近期有过一次短暂的电压波动记录。

- 散热问题:检查机柜风道,发现控制器进风口滤网积灰严重,可能导致长期高温运行。

- 固件版本:该存储的微码版本已较旧,存在一些已知的稳定性问题。

基于此,我们给出了几条具体的运维加固建议:

-

立即执行:

- 清洁所有设备滤网,改善散热环境。

- 制定并测试存储设备的单控制器故障应急切换流程,确保下次单一故障时业务不中断。

- 备份当前所有存储配置和微码。

-

短期计划:

- 安排升级存储系统微码到最新稳定版本。

- 评估并实施存储监控系统的告警升级,将控制器电池健康度、温度等指标纳入重点监控。

-

长期考虑:

- 评估关键业务数据的跨设备或跨机房备份/容灾方案。

- 建立定期的存储健康检查制度,包括日志分析、性能基线比对和灾难恢复演练。

这次经历让我深刻体会到,处理高端存储故障,技术能力固然重要,但严谨的流程、充分的准备和冷静的心态才是成功的基石。每一次成功的恢复,背后都是对技术细节的执着和对数据敬畏之心的体现。

网硕互联帮助中心

网硕互联帮助中心

评论前必须登录!

注册