用Accelerate库三行代码搞定PyTorch分布式训练:从工程噩梦到生产级范式重构

文章目录

- 用Accelerate库三行代码搞定PyTorch分布式训练:从工程噩梦到生产级范式重构

-

- 一、分布式训练:从“硬件堆叠”到“抽象重构”

- 二、什么是Accelerate?

- 三、三行代码:真正的核心抽象

-

- 它背后做了什么?

- 四、工程维度分析:Accelerate的能力映射

-

- 1️⃣ 技术能力映射

- 五、完整训练范式(专业版)

- 六、Accelerate与分布式策略的关系

-

- 它支持哪些策略?

- 七、时间轴视角:现在与未来

-

- 现在(2026年现状)

- 未来5-10年

- 八、价值链分析:谁在受益?

- 九、问题与挑战

-

- 1️⃣ 性能调优空间有限

- 2️⃣ Debug复杂度

- 3️⃣ 抽象与控制的权衡

- 十、一个现实案例:从单卡到8卡

- 十一、与纯DDP的深度对比

- 十二、跨界视角:分布式训练的“软件工程化”

- 十三、一个更深层问题:三行代码是否会削弱理解?

- 十四、未来趋势预测

- 十五、总结:三行代码的真正含义

一、分布式训练:从“硬件堆叠”到“抽象重构”

在大模型时代,分布式训练早已从“性能优化选项”演变为“基础设施前提”。 但真正的痛点并不在算力,而在工程复杂度。

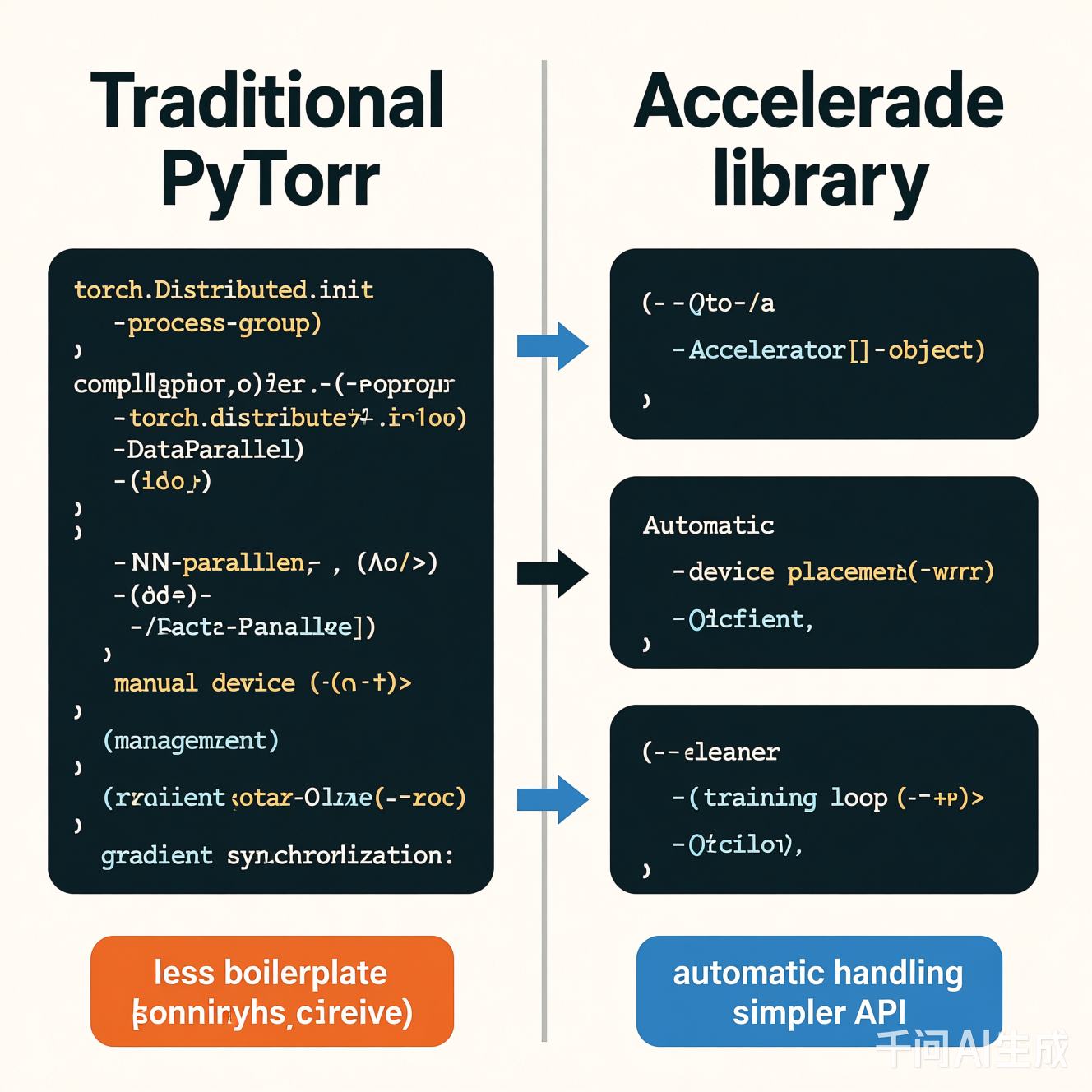

在传统的 PyTorch 分布式训练(DDP) 中,我们通常要处理:

- 多进程初始化

- backend 选择(NCCL / GLOO)

- rank/world_size 管理

- 显式调用 init_process_group

- 数据并行下的 sampler 同步

- 混合精度管理

- 多卡日志冲突

- 多机环境变量配置

其工程结构往往类似这样:

import torch

import torch.distributed as dist

from torch.nn.parallel import DistributedDataParallel as DDP

dist.init_process_group(backend="nccl")

model = MyModel().to(local_rank)

model = DDP(model, device_ids=[local_rank])

train_loader = DataLoader(

dataset,

sampler=DistributedSampler(dataset)

)

问题不在于“写不写得出来”,而在于:

当你把模型、AMP、梯度累积、多节点部署、混合精度、检查点恢复组合在一起时,系统复杂度呈指数级上升。

这正是 Accelerate 的价值所在。

二、什么是Accelerate?

Accelerate 是一个对 PyTorch 分布式体系的“抽象层重构”。

它的核心思想不是重新实现分布式,而是:

统一封装分布式、混合精度、设备管理,使训练代码保持“单机结构”。

你可以把它理解为:

- 对 DDP 的封装

- 对 AMP 的封装

- 对多 GPU / 多节点 / TPU 的统一接口

- 对训练流程的重排控制器

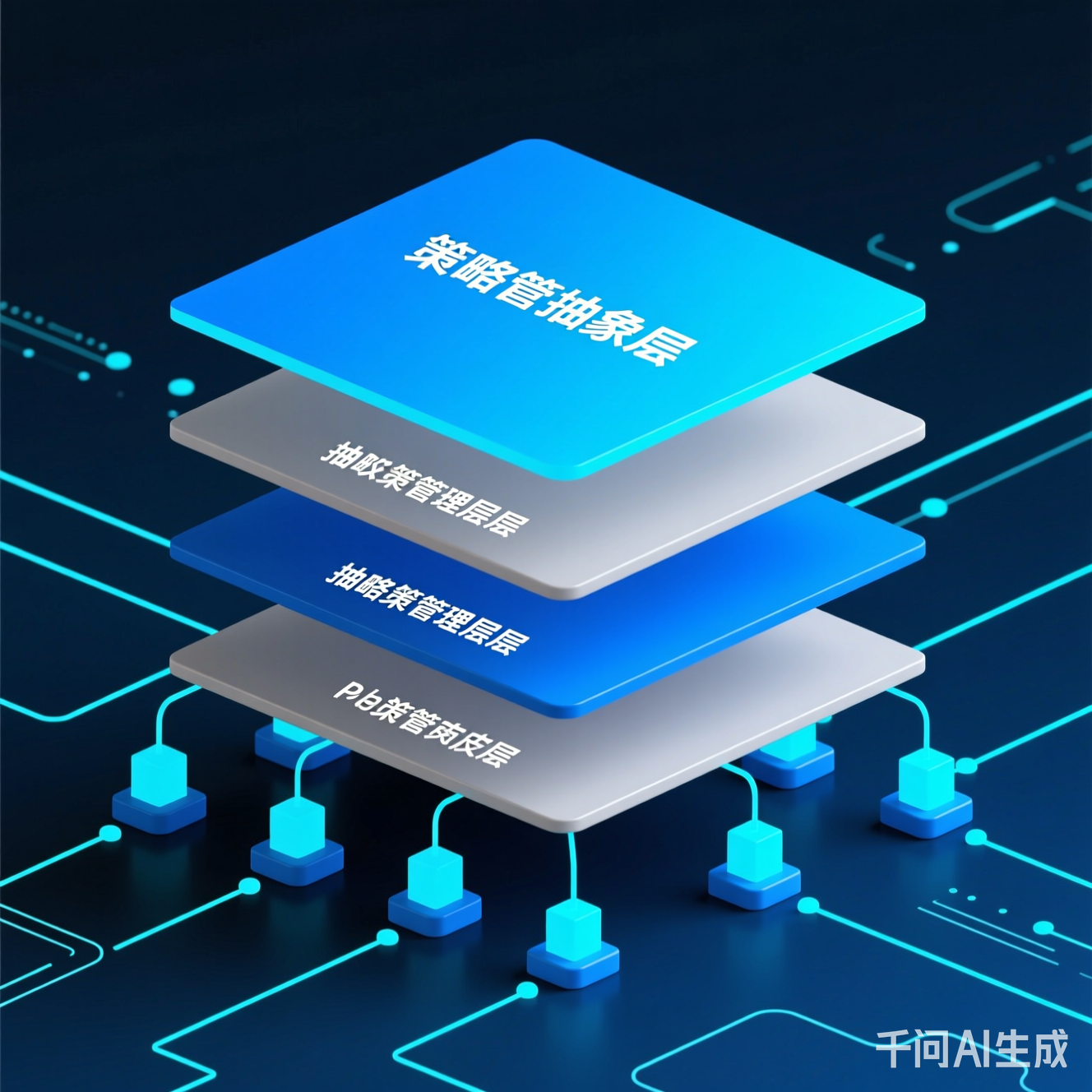

其架构核心如下:

可以看到,它并不是改变 PyTorch,而是构建一个 Runtime Orchestrator。

三、三行代码:真正的核心抽象

Accelerate 的精髓在于这三行:

from accelerate import Accelerator

accelerator = Accelerator()

model, optimizer, dataloader = accelerator.prepare(

model, optimizer, dataloader

)

就这么简单。

它背后做了什么?

accelerator.prepare() 会自动:

这意味着:

- 你写的是单卡逻辑

- 它运行的是多卡结构

四、工程维度分析:Accelerate的能力映射

1️⃣ 技术能力映射

| 多GPU | DDP | 自动封装 |

| 混合精度 | autocast + GradScaler | 内置 |

| 多节点 | 手动配置 | CLI配置 |

| 日志同步 | 手动控制 rank | 自动 |

| 梯度累积 | 自写逻辑 | 内置 |

Accelerate 本质上是 训练流程编排器(Training Orchestrator)。

五、完整训练范式(专业版)

以下是一个真正生产可用的范式:

from accelerate import Accelerator

import torch

from torch.utils.data import DataLoader

accelerator = Accelerator(mixed_precision="fp16")

model = MyModel()

optimizer = torch.optim.AdamW(model.parameters(), lr=3e-5)

dataloader = DataLoader(dataset, batch_size=32, shuffle=True)

model, optimizer, dataloader = accelerator.prepare(

model, optimizer, dataloader

)

for epoch in range(num_epochs):

for batch in dataloader:

outputs = model(batch["input"])

loss = outputs.loss

accelerator.backward(loss)

optimizer.step()

optimizer.zero_grad()

关键点:

- 不再使用 loss.backward()

- 必须使用 accelerator.backward()

- AMP 自动处理

六、Accelerate与分布式策略的关系

它支持哪些策略?

- Data Parallel

- Fully Sharded Data Parallel(FSDP)

- DeepSpeed

- TPU

架构图如下:

它的真正价值在于:

让不同分布式后端变成“可插拔策略”。

七、时间轴视角:现在与未来

现在(2026年现状)

当前趋势:

- 大模型轻量化

- 参数高效微调(PEFT)

- LoRA + FSDP 组合

Accelerate 已经成为:

- 中型模型训练的默认方案

- 微调任务的工程基础设施

未来5-10年

未来训练范式可能会变成:

- 训练即推理(Train-Inference Unification)

- 动态弹性扩缩容

- Serverless 分布式训练

Accelerate 的抽象模型具有天然优势:

只要底层 backend 可扩展,用户代码无需修改。

八、价值链分析:谁在受益?

| 研究人员 | 降低工程负担 |

| 初创团队 | 快速部署 |

| 大规模训练团队 | 标准化训练流程 |

| 教育机构 | 教学门槛降低 |

Accelerate 本质上降低的是:

分布式训练的认知门槛

九、问题与挑战

Accelerate 不是万能的。

1️⃣ 性能调优空间有限

由于抽象层存在:

- 很难做到极致定制

- 对超大规模模型(数百亿参数)仍需底层调优

2️⃣ Debug复杂度

当分布式出错时:

- 错误堆栈被封装

- 调试成本上升

3️⃣ 抽象与控制的权衡

这是经典工程问题:

抽象提升效率,但牺牲可控性。

十、一个现实案例:从单卡到8卡

传统方式迁移:

- 修改入口脚本

- 添加 launcher

- 处理 rank

- 重构 DataLoader

Accelerate 方式:

accelerate config

accelerate launch train.py

训练代码无需修改。

十一、与纯DDP的深度对比

| 学习成本 | 高 | 低 |

| 灵活性 | 极高 | 中等 |

| 上手速度 | 慢 | 快 |

| 维护成本 | 高 | 低 |

| 教学适配 | 差 | 优秀 |

如果你在:

- 做科研原型

- 快速实验

- 迭代模型

Accelerate 是优选。

如果你在:

- 做百亿参数级别优化

- 深度定制通信策略

DDP/FSDP 原生方案更合适。

十二、跨界视角:分布式训练的“软件工程化”

Accelerate 的意义不仅是工具升级。

它代表一种趋势:

机器学习工程正在向软件工程靠拢。

特征包括:

- 抽象层清晰

- 接口统一

- 配置驱动

- 环境隔离

- 可扩展策略

分布式训练不再是“算力问题”,而是“架构问题”。

十三、一个更深层问题:三行代码是否会削弱理解?

这是一个争议点。

当工程复杂性被隐藏:

- 新人可能不理解 DDP 原理

- 分布式概念被弱化

但历史告诉我们:

抽象从来不是削弱能力,而是释放创造力。

没有人因为使用高级语言而失去理解汇编的能力。

十四、未来趋势预测

Accelerate 是第一步:

它让分布式训练从“工程问题”变成“配置问题”。

十五、总结:三行代码的真正含义

三行代码解决的不是分布式本身。

而是:

- 复杂度控制

- 工程范式升级

- 认知负担下降

- 训练结构标准化

当你写下:

accelerator = Accelerator()

model, optimizer, dataloader = accelerator.prepare(...)

你做的不是“简化代码”。

你是在:

把分布式系统的复杂性外包给一个可验证的抽象层。

这才是现代AI工程的核心能力。

如果你真正理解了 Accelerate,你会发现:

它改变的不是 API。

它改变的是:

我们如何思考分布式训练。

而这,才是三行代码背后的真正价值。

网硕互联帮助中心

网硕互联帮助中心

评论前必须登录!

注册