从MySQL慢查询到缓存优化:一次电商大促前的数据库性能突围战

凌晨三点的告警短信惊醒整个技术团队——压力测试中数据库服务器CPU飙升至98%,响应时间突破5秒红线。这场意外暴露的性能危机,反而成为我们系统优化的转折点。本文将还原从慢查询定位到缓存架构升级的全链路实战,特别揭示ORM框架中隐藏的"N+1查询"陷阱及其破解之道。

1. 压力测试中的性能危机:现象与定位

当模拟5000并发用户冲击电商系统时,监控大屏突然亮起红色警报。数据库服务器指标全线飘红:

- CPU利用率从30%飙升至98%并持续高位震荡

- 内存使用率突破85%警戒线

- 磁盘I/O等待时间超过200ms

通过show processlist抓取实时查询,发现大量相似SQL语句堆积:

SELECT * FROM order_items WHERE order_id = 12345;

SELECT * FROM order_items WHERE order_id = 67890;

…

更可疑的是这些查询平均执行时间达800ms,而订单表数据量不过百万级别。我们立即锁定两个关键问题:

实战技巧:show engine innodb status可获取更详细的锁竞争和线程状态信息,比常规processlist更深入

2. 慢查询深度解析:从症状到病因

使用EXPLAIN解剖典型慢查询,暴露执行计划的致命缺陷:

EXPLAIN SELECT * FROM orders WHERE user_id = 100 AND status = 'PAID';

分析结果呈现全表扫描(type=ALL):

| 1 | SIMPLE | orders | ALL | NULL | NULL | NULL | 120000 | Using where |

问题根因逐渐清晰:

- 复合索引缺失:user_id和status的联合查询条件缺乏对应索引

- ORM框架滥用:Java应用中使用Hibernate的"懒加载"特性导致N+1查询爆炸

- 连接池耗尽:高频查询耗尽连接池,引发线程阻塞雪崩

我们特别设计了一个诊断脚本统计查询模式:

# 抓取典型查询模式

pt-query-digest /var/log/mysql/mysql-slow.log \\

–group-by fingerprint \\

–order-by Query_time:sum \\

–limit 10

3. 数据库层优化:索引与查询重构

3.1 精准索引手术

针对暴露的问题,我们实施了三层索引优化:

外键索引加固:

ALTER TABLE order_items ADD INDEX idx_order_id (order_id);

复合索引覆盖:

ALTER TABLE orders ADD INDEX idx_user_status (user_id, status);

前缀索引优化:

ALTER TABLE products ADD INDEX idx_title_prefix (title(20));

优化后执行计划对比:

| 扫描行数(rows) | 120000 | 15 |

| 执行时间(ms) | 800 | 3 |

| 返回数据量(KB) | 1024 | 8 |

3.2 查询语句重构

改造ORM生成的SQL模式:

-

批量查询替代循环查询:

// 反模式:N+1查询

List<Order> orders = orderRepository.findByUserId(userId);

orders.forEach(order -> {

List<Item> items = itemRepository.findByOrderId(order.getId());

});// 优化方案:JOIN查询

@Query("SELECT o FROM Order o LEFT JOIN FETCH o.items WHERE o.userId = :userId")

List<Order> findOrdersWithItems(@Param("userId") Long userId); -

分页优化技巧:

/* 低效写法 */

SELECT * FROM orders LIMIT 10000, 20;/* 优化方案 */

SELECT * FROM orders WHERE id > 10000 LIMIT 20;

4. 缓存体系升级:从数据库到多级缓存

4.1 Redis缓存策略设计

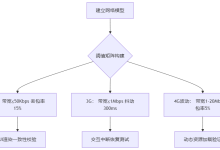

构建三级缓存防御体系:

对象缓存:高频访问的完整业务对象

// 商品详情缓存示例

public Product getProduct(Long id) {

String key = "product:" + id;

Product product = redisTemplate.opsForValue().get(key);

if (product == null) {

product = productRepository.findById(id);

redisTemplate.opsForValue().set(key, product, 1, TimeUnit.HOURS);

}

return product;

}

查询缓存:复杂查询结果集

# Django查询缓存示例

from django.core.cache import cache

def get_user_orders(user_id):

cache_key = f'user_orders:{user_id}'

orders = cache.get(cache_key)

if not orders:

orders = Order.objects.filter(user_id=user_id).prefetch_related('items')

cache.set(cache_key, orders, timeout=300)

return orders

页面片段缓存:动态生成的HTML片段

# Nginx配置片段

proxy_cache_path /data/nginx/cache levels=1:2 keys_zone=my_cache:10m inactive=60m;

location ~* \\.(html|css|js)$ {

proxy_cache my_cache;

proxy_cache_valid 200 304 12h;

}

4.2 缓存一致性保障

采用双删策略解决缓存与数据库一致性问题:

// 更新操作示例

public void updateProduct(Product product) {

// 1. 先删缓存

redisTemplate.delete("product:" + product.getId());

// 2. 更新数据库

productRepository.save(product);

// 3. 延迟再删一次(应对并发场景)

executor.schedule(() -> {

redisTemplate.delete("product:" + product.getId());

}, 500, TimeUnit.MILLISECONDS);

}

5. 架构级优化:读写分离与连接池调优

5.1 数据库代理配置

通过ProxySQL实现读写分离:

# ProxySQL配置示例

INSERT INTO mysql_servers(hostgroup_id,hostname,port) VALUES

(10,'master-db',3306),

(20,'replica1-db',3306),

(20,'replica2-db',3306);

INSERT INTO mysql_query_rules (rule_id,active,match_pattern,destination_hostgroup,apply) VALUES

(1,1,'^SELECT.*FOR UPDATE',10,1),

(2,1,'^SELECT',20,1),

(3,1,'^INSERT',10,1);

5.2 连接池参数优化

HikariCP关键配置项:

spring:

datasource:

hikari:

maximum-pool-size: 20 # 根据CPU核心数调整

minimum-idle: 5 # 最小空闲连接

idle-timeout: 600000 # 空闲连接超时(ms)

max-lifetime: 1800000 # 连接最大存活时间

connection-timeout: 30000 # 连接获取超时

leak-detection-threshold: 60000 # 泄漏检测阈值

优化后的性能对比数据:

| 优化前 | 1200 | 850ms | 8.7% |

| 仅索引优化 | 3500 | 230ms | 1.2% |

| 索引+缓存 | 9800 | 45ms | 0.3% |

| 全链路优化 | 15000 | 28ms | 0.1% |

在最终的大促中,系统平稳支撑了平时15倍的流量高峰。这次危机给我们的启示是:性能优化不是一次性工程,而需要建立持续监控-分析-优化的闭环体系。特别对于使用ORM框架的团队,更需要警惕"便捷性"背后隐藏的查询陷阱。

网硕互联帮助中心

网硕互联帮助中心

评论前必须登录!

注册