多模态 AI 驱动办公智能化变革:DeepSeek 赋能图文转写与视频摘要的高效实践

摘要: 人工智能正以前所未有的速度重塑现代办公形态,其中多模态人工智能(Multi-modal AI)技术的崛起尤为引人注目。它打破了传统单模态信息处理的局限,使机器能够像人类一样理解、关联并处理文本、图像、音频、视频等多种形式的信息。DeepSeek 作为先进的大语言模型(LLM),在多模态信息处理领域展现出强大的潜力。本文将深入剖析多模态 AI 与办公场景融合的核心趋势,聚焦 DeepSeek 在图文信息转写(将图像/PDF 中的内容转化为结构化文本)和视频摘要生成(提炼视频核心内容为精简文本)两大关键场景中的应用。文章不仅探讨技术原理与价值,更提供一系列经过验证的高效实践技巧、优化策略和行业应用案例,旨在为企业和个人提供切实可行的智能化办公升级路径,提升信息处理效率和决策质量。

一、 引言:办公场景的智能化演进与多模态 AI 的必然性

办公场景的核心是信息的创造、流转、处理与决策。传统办公模式中,信息多以碎片化、多源异构的形态存在:

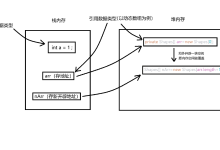

单模态 AI(如仅处理文本或仅识别图像)虽能在特定环节提升效率,但面对上述复杂混合信息场景时,其局限性显露无遗。多模态 AI 的出现,正是为了解决这一痛点。 它通过构建统一的跨模态理解框架,能够:

- 联合理解 (Joint Understanding): 同时解析文本、图像中的信息,并理解其内在关联。例如,看懂一张包含数据图表的幻灯片(图)及其旁边的文字说明(文)。

- 跨模态转换 (Cross-modal Translation): 将一种模态的信息转化为另一种模态。这正是图文转写和视频摘要的核心任务。

- 信息融合与推理 (Information Fusion & Reasoning): 综合来自不同模态的线索,进行更深层次的推理和决策支持。

DeepSeek 等大型语言模型,通过在海量多模态数据(图文对、视频-文本对等)上进行预训练,并结合先进的神经网络架构(如 Transformer),具备了强大的跨模态表示学习和生成能力。将其引入办公场景,能够显著提升信息处理自动化水平和知识提取效率。

二、 多模态 AI 赋能办公的核心场景与 DeepSeek 的优势

DeepSeek 在多模态办公场景中的核心价值体现在其强大的语义理解能力、上下文建模能力和可控文本生成能力。以下聚焦两大最具代表性的应用场景:

场景一:图文转写 – 从图像/PDF 到结构化文本

- 任务定义: 将包含文字的图像(如扫描文档、照片、截图)或 PDF 文件中的内容,准确、高效地识别并提取出来,转化为可编辑、可搜索、可分析的结构化文本(如 Word, Markdown, JSON 等)。这超越了简单的光学字符识别(OCR)。

- 传统痛点:

- OCR 精度问题:复杂排版、模糊图像、手写体、特殊符号识别困难。

- 缺乏语义理解:OCR 输出的是“字符序列”,而非“有意义的文本块”。表格、列表等结构化信息难以保留。

- 后处理繁琐:需要人工校对、分段、格式调整。

- DeepSeek 的赋能:

- 强大的 OCR 后处理与语义理解: DeepSeek 可以接收 OCR 引擎(如 Tesseract, PaddleOCR)的初步识别结果,利用其语言模型进行纠错、语义消歧、句子重组。例如,它能判断“1 O”是“10”还是“IO”,理解“Fig. 1”代表图表标题。

- 结构化信息提取: DeepSeek 能识别文档的逻辑结构(标题、正文、列表、表格),理解表格的行列关系,并将其转化为 Markdown 表格或结构化数据(如 JSON)。例如:

{

"title": "2024年Q1销售报告",

"author": "销售部",

"date": "2024-04-10",

"tables": [

{

"caption": "区域销售额统计",

"headers": ["区域", "销售额(万元)", "同比增长"],

"rows": [

["华东", "1200", "15%"],

["华北", "980", "8%"],

["华南", "1500", "22%"]

]

}

]

} - 复杂文档处理: 处理包含混合文字、公式、图表的文档。DeepSeek 可识别 LaTeX 格式的数学公式(如识别图像中的 $E = mc^2$ 并正确输出为 LaTeX 代码),或描述图表内容。

- 内容总结与提炼: 在转写的同时,可要求 DeepSeek 对提取的内容进行摘要,快速抓住重点。

场景二:视频摘要生成 – 从冗长视频到精华摘要

- 任务定义: 自动分析视频内容(包含视觉画面和音频/语音),提取关键信息、事件、论点或情感,生成一段简洁、连贯、覆盖核心内容的文本摘要。

- 传统痛点:

- 观看耗时:长视频需要大量时间观看。

- 信息密度低:视频包含冗余信息、停顿、无关镜头。

- 手动摘要困难:人工提炼费时费力,主观性强,易遗漏重点。

- DeepSeek 的赋能:

- 多模态融合理解: DeepSeek 可以处理视频的转录文本(由语音识别 ASR 生成)和关键视觉信息(由视觉模型提取的场景描述、物体识别、人物动作、文字信息等)。它融合这两种模态的信息,理解画面与语音的对应关系(如“演示者指向屏幕上的图表”)。

- 内容重要性评估: 基于语言模型和视觉理解,DeepSeek 能判断哪些片段包含核心论点、关键数据、重要结论或情感转折点。例如,识别出“接下来我们宣布季度业绩”比“今天天气不错”更重要。

- 连贯摘要生成: 基于筛选出的关键信息点,DeepSeek 利用其强大的文本生成能力,组织语言,生成一段逻辑清晰、语言流畅、覆盖主要内容的摘要。摘要可以是指令性的(“会议决定…”)、描述性的(“演示者介绍了…”)或问答式的(“Q: 本季度目标?A: 增长15%”)。

- 支持多种格式: 可生成纯文本摘要、带时间戳的要点列表、会议纪要模板、Q&A 对等。

DeepSeek 的核心优势:

三、 DeepSeek 图文转写高效实践技巧

高效、高精度地利用 DeepSeek 进行图文转写,需要结合技术工具和策略方法:

技巧一:优化输入质量(预处理是关键)

- 图像清晰度: 确保提供给 OCR 引擎的图像足够清晰。对于模糊或低分辨率扫描件,使用图像处理工具(如 OpenCV, PIL)进行预处理:

from PIL import Image, ImageEnhance

# 示例:调整对比度和锐度

image = Image.open('scanned_doc.jpg')

enhancer = ImageEnhance.Contrast(image)

image_enhanced = enhancer.enhance(2.0) # 增加对比度

enhancer = ImageEnhance.Sharpness(image_enhanced)

image_final = enhancer.enhance(2.0) # 增加锐度

image_final.save('preprocessed_doc.jpg') - OCR 引擎选择与调优: 选择高性能 OCR 引擎(如 PaddleOCR 对中文支持好,Tesseract 对英文支持好)。根据文档类型调整参数:

# 使用 PaddleOCR

from paddleocr import PaddleOCR

ocr = PaddleOCR(use_angle_cls=True, lang='ch', use_gpu=False) # 启用方向分类,中文,不使用GPU

result = ocr.ocr('preprocessed_doc.jpg', cls=True)

# 获取识别文本和坐标

text_blocks = []

for line in result:

for word_info in line:

text = word_info[1][0]

confidence = word_info[1][1]

points = word_info[0] # 四边形坐标点

if confidence > 0.8: # 置信度阈值

text_blocks.append({'text': text, 'points': points}) - 结构化 OCR 输出: 将 OCR 结果按文本块(基于坐标)组织,保留位置信息。这对于 DeepSeek 理解文档结构至关重要。

技巧二:精心设计 Prompt 引导 DeepSeek

Prompt 是与 DeepSeek 沟通的桥梁,直接影响输出质量。针对图文转写:

- 明确任务: “请将以下 OCR 识别的文本块转换为结构清晰的 Markdown 文档。文本块包含位置信息。”

- 指定格式: “识别标题(通常字体较大或在顶部)、正文段落、项目符号列表(以 ‘-’ 或数字开头)、表格(行列对齐的文字)。将标题转换为 # 级别,列表用 -,表格用 Markdown 表格语法。”

- 处理特定元素:

- 公式:“如遇到类似 $E = mc^2$ 的文本,保留其作为 LaTeX 内联公式。”

- 图表:“对文本中提及的图表(如 ‘如图 1 所示’),在相应位置插入 ![Fig 1] 占位符。”

- 模糊识别:“如果某些单词识别置信度低,在其后标注 [?]。”

- 设定风格: “保持原文风格,正式/非正式。不添加额外解释。”

- 示例 (Few-shot Learning): 在 Prompt 中提供少量输入输出示例,能显著提升模型表现。

[输入文本块 1] (位置: 顶部): '2024年度项目计划书'

[输入文本块 2] (位置: 左上): '1. 项目目标'

[输入文本块 3] (位置: 左下): '提升市场份额至25%'

…

[期望输出]:

# 2024年度项目计划书

## 1. 项目目标

* 提升市场份额至25%

…

技巧三:分阶段处理与迭代优化

技巧四:处理复杂文档

- 分区域处理: 对于版面复杂的文档(如杂志),可先使用版面分析模型(如 LayoutLM, PaddleOCR 的版面分析功能)将文档分割成标题区、正文区、表格区、图片区等。然后对不同区域分别应用 OCR 和 DeepSeek 处理策略。

- 公式与特殊符号: 使用专门的数学 OCR 工具(如 Mathpix)处理公式区域,将得到的 LaTeX 代码作为特殊文本块输入 DeepSeek,并在 Prompt 中说明“$$…$$ 包裹的内容为 LaTeX 公式,请保留原样”。

- 手写体: 当前手写体 OCR 仍是挑战。可尝试专用手写体识别模型,或提示 DeepSeek “以下文本块来自手写体识别,可能存在较多错误,请尝试结合上下文进行语义纠错”。

技巧五:自动化与集成

- 批处理脚本: 编写脚本自动化执行预处理 -> OCR -> DeepSeek 转写 -> 后处理流程。

- 文档管理系统集成: 将自动化转写流程集成到企业文档管理系统(DMS)或知识库平台中,设置触发规则(如新上传扫描件自动触发转写)。

- 云服务 API: 利用 DeepSeek 的 API 服务,构建可扩展的云处理平台。

四、 DeepSeek 视频摘要生成高效实践技巧

高效生成高质量视频摘要,需要融合语音识别、视觉理解和文本生成技术:

技巧一:高质量语音转录 (ASR) 是基石

- 选择合适 ASR 引擎: 根据视频语言、口音、背景噪音选择。如 DeepSeek 自身可能提供 ASR,或集成 Whisper(开源,多语言支持好)、阿里云/腾讯云 ASR 服务。

- 带时间戳的转录: 确保 ASR 输出包含每个单词或句子的起止时间戳。这是定位关键片段的基础。

# 使用 Whisper 示例 (简化)

import whisper

model = whisper.load_model("medium")

result = model.transcribe("meeting_video.mp4")

for segment in result['segments']:

start = segment['start']

end = segment['end']

text = segment['text']

print(f"[{start:.2f}s – {end:.2f}s] {text}") - 说话人分离 (Diarization): 识别并区分不同的说话人(如“Speaker 1: …”, “Speaker 2: …”)。这对理解对话和归属观点很重要。可使用 pyannote.audio 等工具。

- 转录后处理: 对 ASR 原始文本进行初步清洗(去除填充词如“呃”、“啊”),但保留完整语义。DeepSeek 也可用于 ASR 文本的纠错和润色。

技巧二:视觉信息提取辅助理解

虽然 DeepSeek 主要处理文本,但可结合视觉模型提取的关键信息作为补充:

- 场景分类/描述: 使用图像分类或描述模型(如 CLIP, BLIP)对关键帧或均匀采样的帧进行分析,生成简短描述(如“会议室场景”、“白板讨论”、“产品演示幻灯片”)。

- 屏幕内容识别: 对演示类视频,使用 OCR 识别屏幕共享区域中的文字(幻灯片标题、要点、图表标签)。

- 人脸与表情识别 (谨慎使用): 可识别主要发言人,或在合规前提下分析大致情绪(积极/中性/消极),作为理解语气的辅助参考。

- 动作识别: 简单动作描述(如“举手”、“指向屏幕”)可能有助于理解互动。

技巧三:Prompt 设计驱动高质量摘要

Prompt 是引导 DeepSeek 生成理想摘要的核心:

- 明确摘要目标: “请根据提供的视频转录文本(带时间戳)和视觉场景描述,生成一份精简的会议内容摘要。”

- 定义摘要类型:

- 要点式:“生成 5-7 个关键要点,每个要点 1-2 句话。”

- 段落式:“生成一段连贯的总结性文字,不超过 200 字。”

- 问答式:“根据内容生成 3-5 个重要问题及其答案 (Q&A)。”

- 行动项导向:“重点提取会议中明确的决策和待办事项(Action Items),包括负责人和截止时间(如有提及)。”

- 指定内容侧重点: “摘要应涵盖:主要讨论议题、各方核心观点、达成的共识或决策、存在的分歧、下一步行动计划。避免记录闲聊和无关细节。”

- 利用时间戳定位: “关注在 [00:05:21 – 00:07:30] 时间段内讨论的预算议题。” 或 “发言人 A 在 [00:15:40] 左右提出的风险点需要包含。”

- 结合视觉信息: “当视觉描述提到‘展示销售趋势图’时,对应的讨论内容应包含图表反映的关键数据结论。”

- 设定语言风格: “使用正式、客观的商务语言。” 或 “摘要供内部快速参考,语言可稍口语化。”

- 结构化输出: “使用 Markdown 格式:## 主要议题 \\n … \\n ## 关键决策 \\n … \\n ## 行动项 \\n …”

- 提供示例 (Few-shot Learning): 同样有效。

技巧四:分阶段摘要与信息融合策略

- 基于文本: 利用 DeepSeek 的文本理解能力,快速扫描转录文本,识别潜在重要段落(如包含“总结”、“决定”、“风险”、“目标”等关键词,或发言密度高的区域)。可让 DeepSeek 先输出一个“潜在重要时间戳列表”。

- 基于视觉(可选): 结合视觉描述的变化(如切换幻灯片、出现白板书写)定位可能的重要片段。

技巧五:元数据与知识库整合

- 关联会议信息: 将生成的摘要与会议日历事件、参会人列表、相关文档(议程、预读材料)关联,存入知识库。

- 结构化存储: 将摘要中的关键要素(议题、决策、行动项)抽取出来,转化为结构化数据,便于搜索和分析。

- 时间线标注: 在摘要中嵌入关键点对应的时间戳(如 “[00:12:15] 决定:…”),方便用户回看原视频细节。

技巧六:自动化工作流

- 视频上传触发: 设置规则,新视频上传到特定平台(如 Teams, Zoom Cloud, 内部服务器)后自动触发处理流程。

- 流程串联: 自动化执行:视频 -> ASR (带时间戳) -> 视觉分析 (可选) -> DeepSeek 摘要生成 -> 摘要存储/分发 (邮件、知识库、聊天机器人)。

- 通知与分发: 自动将生成的摘要通过邮件发送给参会者或相关团队,或推送到协作平台(如 Slack, Teams)。

五、 效能提升与优化策略

除了具体技巧,还需考虑以下策略以最大化效能:

- 计算 ROI: 对比使用 DeepSeek 自动化处理(含计算资源、API 调用成本)与原有手动处理的人力成本和时间成本。通常自动化在规模效应下优势明显。

- 任务分级: 对文档和视频进行分级(重要性、复杂度),对高价值或高频率任务优先部署自动化,对低价值任务可部分自动化或暂缓。

- 本地化部署: 对敏感数据(合同、内部会议),考虑 DeepSeek 的本地化部署方案,避免数据上云。

- 数据脱敏: 在调用 API 前,对敏感信息(身份证号、金额、人名)进行遮蔽或替换。

- 合规性审查: 确保处理流程符合 GDPR、HIPAA、中国个人信息保护法等法规要求。明确数据存储、访问控制、审计日志策略。

- 基础模型 vs 微调模型: 评估是否需要使用领域特定数据对 DeepSeek 进行微调,以提升在专业术语、行业文档结构理解上的表现。

- 模型大小权衡: 在效果、速度和成本之间权衡。大型模型效果更好但更贵更慢,小型模型反之。

- AI 作为助手: 定位 AI 为提升效率的工具,而非完全替代人类。摘要和转写结果需人工复核,尤其是关键决策和法律文件。

- 反馈闭环: 建立机制让用户对 AI 生成结果进行纠错和评分,用于持续改进 Prompt 或模型。

- 设置 KPI: 跟踪平均处理时间、准确率(与人工校对对比)、用户满意度。

- 定期评估: 随着 DeepSeek 模型更新和新技术出现,定期评估现有方案,探索进一步优化空间。

六、 行业应用案例与价值

案例一:法律与合规部门

- 场景: 海量合同、法规文件审查。

- 应用: DeepSeek 图文转写提取合同关键条款(如付款条件、违约责任、保密条款),并自动对比不同版本差异。视频摘要用于快速回顾冗长的合规培训录像或监管机构说明会。

- 价值: 加速合同审查流程 60%,降低漏检风险,确保合规要求被及时掌握。

案例二:金融服务

- 场景: 处理财报、研报、路演视频、客户会议记录。

- 应用: 转写财报中的财务数据表格用于分析;摘要路演视频核心观点供投资决策;提炼客户会议记录中的需求与风险点。

- 价值: 缩短信息获取时间,提升投研效率和客户响应速度,辅助风险识别。

案例三:医疗健康

- 场景: 处理病历(扫描件)、医学影像报告、学术会议视频。

- 应用: 转写手写或扫描的病历为结构化电子病历;摘要医学会议中最新研究成果和治疗方案。

- 价值: 改善病历管理效率,促进知识快速传播与应用,辅助临床决策。(注:需严格遵守医疗数据隐私法规)

案例四:教育与培训

- 场景: 讲义资料数字化、录播课程摘要。

- 应用: 转写扫描讲义为可编辑文档;生成长视频课程的章节摘要或知识要点卡片。

- 价值: 方便学员复习检索,提升学习效率;减轻教师内容整理负担。

案例五:制造业与供应链

- 场景: 处理质检报告、设备手册、供应商沟通记录(邮件/视频会议)。

- 应用: 转写纸质质检报告数据用于分析;摘要供应商会议中的交货承诺和问题反馈。

- 价值: 加速质量问题追溯,确保供应链信息畅通,优化采购决策。

通用价值总结:

- 效率提升: 自动化低价值信息处理任务,释放人力专注于高价值工作。

- 知识沉淀: 将非结构化信息(图像、视频)转化为可搜索、可分析的结构化知识,构建企业知识库。

- 决策加速: 快速获取关键信息洞察,缩短决策周期。

- 成本节约: 减少人工录入、整理、查看的时间成本和人力成本。

- 体验改善: 员工从繁琐工作中解脱,客户获得更快响应。

七、 挑战、风险与未来展望

挑战与风险:

应对策略:

- 人机共审: 关键输出必须有人工审核环节。

- 溯源能力: 摘要应能关联回原始视频片段或文档位置。

- 模型可解释性: 探索方法理解模型为何做出特定摘要或转写决策。

- 持续训练与评估: 用新数据和反馈更新模型,评估其公平性表现。

- 强健的安全架构: 实施加密、访问控制、审计。

未来展望:

八、 结论

多模态人工智能,特别是以 DeepSeek 为代表的大型语言模型,正在深刻改变信息密集型的办公场景。图文转写和视频摘要生成作为两大核心应用,将大量从“看得见、听得着”但“难处理、难利用”的非结构化信息,转化为“可编辑、可搜索、可分析”的结构化知识,极大地释放了信息的生产力价值。

通过实施本文介绍的高效实践技巧——从输入预处理、精心设计 Prompt、分阶段处理、人机协同到自动化集成——企业和个人能够显著提升图文转写和视频摘要的效率、精度和可用性。尽管挑战(如精度、安全、幻觉)依然存在,但随着技术的持续迭代、安全措施的完善以及人机协作模式的优化,多模态 AI 驱动的办公智能化变革浪潮不可阻挡。拥抱这一趋势,积极部署和应用 DeepSeek 等先进工具,将是企业和知识工作者提升核心竞争力、迈向高效智能办公未来的关键一步。

附录:DeepSeek 图文转写/视频摘要高效 Prompt 模板库 (示例)

- 通用图文转写 (Markdown):

你是一位文档处理专家。请将以下经过 OCR 识别并分块的文本(每个块包含文本内容 `text` 和其在原图中的位置坐标 `points`)转换为结构清晰、格式规范的 Markdown 文档。具体要求:

1. 根据文本位置和字体大小(位置靠上/居中且文本较短可能为标题)识别文档标题,用 `# ` 表示。

2. 识别章节标题,用 `## ` 或 `### ` 表示。

3. 将连续文本识别为段落。

4. 识别编号列表(如 1. 2. 3. 或 a) b) c))或项目符号列表(如 • – *),用 Markdown 列表语法表示。

5. 识别表格:根据文本块坐标判断行列对齐关系,用 Markdown 表格语法 `| 表头 | … |` 表示。确保行列对应正确。

6. 保留原始文本中的加粗、斜体等格式(如果 OCR 能识别或能推断)。

7. 遇到类似 `$E = mc^2$` 或 `$$\\int_a^b f(x)dx$$` 的文本,识别为数学公式,保留其 LaTeX 格式。

8. 对识别置信度低的单词,在其后标注 `[?]`。

9. 输出只包含转换后的 Markdown 内容,无需额外解释。

[OCR 文本块数据]: {text_blocks_json} - 合同关键条款提取 (JSON):

你是一位法律助理。请从以下合同文档的 OCR 转写文本中,提取以下关键条款的信息,并以 JSON 格式输出。确保信息准确无误:

{

"parties": ["甲方全称", "乙方全称"],

"effective_date": "YYYY-MM-DD",

"term": "合同期限描述",

"payment_terms": "付款条件详细描述",

"termination_clauses": ["终止情形1", "终止情形2"],

"liability_limits": "责任限制描述",

"confidentiality_scope": "保密信息范围描述"

}

文本内容:[合同全文 OCR 文本] - 会议视频摘要 (行动项导向):

你是一位专业的会议纪要员。请根据提供的视频会议转录文本(带时间戳 `[start-end]` 和说话人 `[Speaker]`)和关键视觉场景描述,生成一份以 **行动项 (Action Items) ** 为核心的摘要。要求:

1. 首先,简要列出会议主要议题(不超过 3 个)。

2. 重点提取会议中明确提出的、需要后续跟进的所有行动项。每个行动项必须包含:

* `action`: 具体要做什么(清晰描述)。

* `owner`: 负责人(从对话中识别,如未明确则标 `待定`)。

* `deadline`: 截止时间(如提及,格式 `YYYY-MM-DD`;如未明确则标 `待定`)。

* `context`: 简要说明该行动项提出的背景或原因(1 句话)。

* `timestamp`: 提出行动项的大致时间 `[HH:MM:SS]`。

3. 其次,记录会议中达成的重要 **决策 (Decisions)**。每个决策包括 `decision` (内容) 和 `timestamp`。

4. 最后,记录需要持续关注的 **关键问题/风险 (Open Issues/Risks)** (如有)。

5. 使用 Markdown 格式,分 `## 主要议题`、`## 行动项`、`## 决策`、`## 待解决问题` 几个部分。

6. 语言简洁、客观、正式。

[视频转录文本]:{transcript_with_timestamps}

[视觉场景描述]:{key_visual_descriptions} (可选)

网硕互联帮助中心

网硕互联帮助中心

评论前必须登录!

注册