一 LangFlow的下载以及配置

1.安装Python3.10

https://www.python.org/downloads/

2.安装LangFlow

一般情况使用pip安装Langflow,但我这里不建议使用pip安装,因为pip的版本会影响安装的一个成功性

所以我这里推荐uv安装

在系统命令行中执行

pip install uv

如果速度不理想换成

pip install uv -i https://pypi.tuna.tsinghua.edu.cn/simple

阿里云:pip install uv -i https://mirrors.aliyun.com/pypi/simple/

腾讯云:pip install uv -i https://mirrors.cloud.tencent.com/pypi/simple

新建一个文件夹作为LangFlow的项目文件夹

在这个文件夹中打开powersheel(一定要以管理员身份打开)

1. 创建名为 "venv" 的虚拟环境

python -m venv venv

2. 激活这个虚拟环境

.\\venv\\Scripts\\activate

# 激活后,命令行最前面会出现 (venv) 标记

3. 在激活的虚拟环境中安装Langflow

uv pip install langflow

等待运行完成

输入

langflow –version

检查是否安装成功

安装成功之后

langflow run –host 127.0.0.1 –port 7860

在浏览器输入网址以及端口打开查看是否可以运行

(此方法需要每回进行run的一个操作,所以我这里推荐进行创建一个快捷启动脚本,在langflow项目文件夹中创建一个文本,重命名为start.bat 然后编辑

@echo off

call .\\venv\\Scripts\\activate

langflow run –host 127.0.0.1 –port 7860

pause

)以后启动时直接双击.bat文件就可以

停止时按下Ctrl+C

二 LMStudio下载(其实我更推荐使用ollama)(对模型感兴趣的还有ModelScope可以去下载测试)

https://lmstudio.ai/

下载LMStudio

在里面搜索模型并下载,下载完成后切换到chat标签页将下载的模型加载

启动本地api服务器

在develop标签页中start server

总的来说

总体流程

下载并加载模型:

打开 LM Studio,在 “Discover” 页面,搜索并下载一个模型(如 Llama-3-8B-Instruct)。

切换到 “Chat” 标签页,从左上角下拉菜单中选中刚下载的模型,点击 “Load” 将其加载到内存。

启动本地服务器(核心步骤):

切换到 “Local Server” 标签页。

确认服务器地址为 http://localhost:1234(通常是默认的)。

点击 “Start Server” 按钮。

成功标志:按钮上方出现 “Server is running” 的绿色提示。

(重要验证):

打开你电脑上的任意浏览器(如Chrome)。

在地址栏输入 http://localhost:1234/v1/models 并访问。

预期结果:页面应显示一段包含模型信息的JSON代码。这证明你的“AI引擎”已准备就绪,可以对外服务。

需要注意的一点是LMStudio的下载都默认在C盘里面,包括内存很大的模型,因此改位置很重要

在C盘里面有一个.lmstudio的文件,将此文件剪切到别的内存大的盘(的一个文件夹)例如E:\\LMData

然后创建符号链接(打开cmd输入以下命令)

cd /d C:\\Users\\用户名

mklink /J ".lmstudio" "E:\\LMData\\.lmstudio"

成功标志:命令行显示“为 .lmstudio <<===>> E:\\LMData.lmstudio 创建的联接”。

最终验证:再次打开 C:\\Users\\赫 目录,你应该会看到一个带快捷方式小箭头的 .lmstudio 图标。双击它能正常跳转并显示E盘的内容。

一定要以管理员身份进行以上操作

另外,模型下载位置可以在软件里面直接更改(这里不做说明)一找就可以找到

三 Langflow+LMStudio协同使用

1. 启动引擎

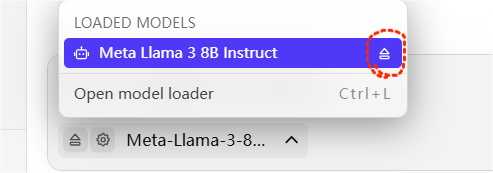

(LM Studio)a. 加载模型:打开LM Studio,在 Chat 页点击 Pick a model (或按Ctrl+L),选择并加载模型。

b. 启动服务:切换到 Local Server 页,确保 Require Authentication 关闭,点击 Start Server。验证服务:在浏览器访问:

http://localhost:1234/v1/models

必须看到返回模型列表的JSON。

2. 启动控制中心

(LangFlow)运行已修改的 .bat启动文件,其中必须包含 set OPENAI_API_KEY=lm-studio 行。验证界面:浏览器能正常打开:

http://127.0.0.1:7860

3. 构建工作流

(LangFlow中)a. 选模板:可选用 Basic Prompting 模板。

b. 配组件:添加 LM Studio 组件,关键配置:

– Base URL: http://localhost:1234/v1

– Model Name: 填写API返回的ID(如meta-llama-3-8b-instruct)。

c. 连线路:连接 ChatInput → LM Studio → ChatOutput。验证配置:Base URL带/v1,Model Name与API返回的id完全一致。

4. 运行测试点击画布右上角的 Run 按钮,在右侧聊天窗发送消息。验证成功:收到来自本地模型的正常回复。

5. 正确关闭a. 关LangFlow:在其命令行窗口按 Ctrl+C。

b. 停LM服务:在LM Studio的 Local Server 页点击 Stop Server。

c. 卸载模型:在 Chat 页找到模型控制区,点击 Unload 释放内存。

d. 退软件:退出LM Studio。验证释放:任务管理器中无相关进程占用,端口空闲。

注意:1.可能会遇到apiKey的一个报错,当遇到这个报错的时候,在之前创建的.bat文件中添加

set OPENAI_API_KEY=lm-studio

就可以

2.LMStudio中unload释放模型内存

点击红色圈的图表即可释放内存

网硕互联帮助中心

网硕互联帮助中心

评论前必须登录!

注册