在大模型飞速发展的当下,RAG(Retrieval-Augmented Generation)已经成为许多AI系统的标配“外挂大脑”。它让模型不再“死记硬背”,而是能“查资料再答题”,极大地提升了生成准确性和时效性。

但!

传统的RAG架构动辄要几百GB的知识库、成堆的GPU资源、复杂的链路设计,对很多中小企业、个人开发者来说:“不是不能用,是用不起。”

于是,LightRAG来了。

它就像是RAG的“精简版”亲兄弟,主打轻量、快速、易部署,让更多人也能拥有属于自己的智能问答系统。

今天我们就一起来拆解一下——

LightRAG到底是什么?能做什么?怎么用?未来又能走到哪?

一、什么是LightRAG?

我们先复习一下大哥 RAG 的概念:

RAG = “检索 + 生成”架构。

模型在回答问题时,先从知识库中检索出相关内容,然后再生成回答。

而 LightRAG(Lightweight Retrieval-Augmented Generation),则是在保留RAG核心优势的基础上:

精简模型体积

降低硬件依赖

简化部署流程

提供开箱即用的组件组合

你可以理解为它是「RAG 的轻装旅行版」,但依然能搞定日常大多数应用场景。

二、哪里可以用LightRAG?

虽然LightRAG是“轻量级”的,但它可一点都不“轻浮”。以下这些真实场景,都能用它搞定:

1. 企业知识库问答

上传公司手册、流程PDF,LightRAG 可回答“请问请假流程怎么走?”、“某岗位的KPI是什么?”

2.医疗文献查询助手

导入临床指南或医学文献,医生可直接问“某病症的一线治疗方法有哪些?”

3.电商产品客服

对接商品FAQ文档,用户可提问“这个洗衣机能洗羊毛吗?” LightRAG自动查找相关问答返回。

4.教学资料问答

上传学生教材或讲义,学生问“牛顿第三定律的核心观点是?”,它能直接给出教材中的原话。

5.个人知识助手

你也可以上传你自己的学习笔记、书摘、文章资料,打造你的专属“知识大脑”。

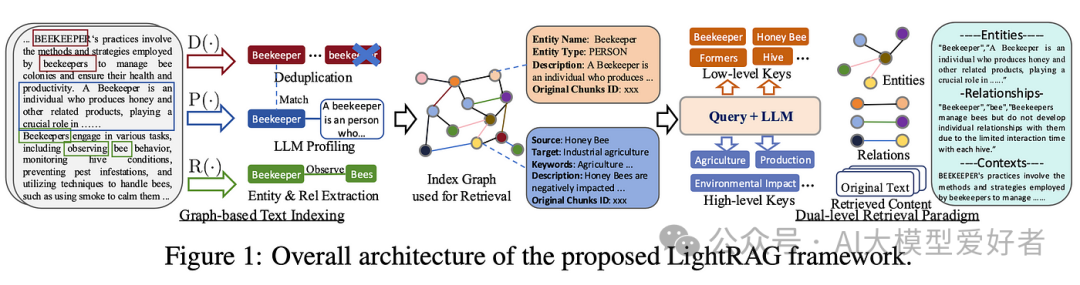

三、LightRAG架构分析和Demo部署

LightRAG基本组成

LightRAG整体结构比传统RAG更清爽,核心组件如下:

流程简图如下:

用户问题 → 文本向量化 → 相似文档Top-k → 拼接上下文 → 送进LLM生成答案

快速上手:代码实战(Python)

以下是用 LangChain + FAISS + MiniLM 构建 LightRAG 的简化版代码:

from langchain.embeddings import HuggingFaceEmbeddingsfrom langchain.vectorstores import FAISSfrom langchain.llms import HuggingFacePipelinefrom langchain.chains import RetrievalQAfrom transformers import pipeline# 1. 向量化模型(MiniLM)embedding_model = HuggingFaceEmbeddings(model_name="sentence-transformers/all-MiniLM-L6-v2")# 2. 构建知识库docs = ["员工可以请带薪年假,每年最多10天。", "销售需每季度提交一次客户拜访记录。"]vector_db = FAISS.from_texts(docs, embedding_model)# 3. 搭建LLMqa_pipeline = pipeline("text-generation", model="Qwen/Qwen1.5-0.5B", device=0)llm = HuggingFacePipeline(pipeline=qa_pipeline)# 4. 组装成LightRAGqa = RetrievalQA.from_chain_type(llm=llm, retriever=vector_db.as_retriever(), chain_type="stuff")# 5. 体验问答question = "请问员工年假有几天?"print(qa.run(question))

部署方式建议:

- 本地部署:使用 Gradio/Streamlit 构建简单界面即可

- 云端部署:通过 Docker 容器 + FastAPI 提供服务接口

- 支持量化模型:可使用 INT8 版本 LLM 模型节省显存资源

四、LightRAG的优缺点与发展趋势

1.优点亮点:

| 轻量高效 | 低资源运行,笔记本也能用 |

| 易部署 | 模块组合灵活,无需复杂微调 |

| 开源生态丰富 | 支持 HuggingFace / LangChain / Chroma / FAISS 等组件 |

| 成本可控 | 免费模型+本地部署=中小企业友好 |

2.仍有不足:

| ❌ 上下文拼接限制 | Token 限制,长文本覆盖有限 |

| ❌ 无法处理复杂推理链条 | 不支持多轮“搜索-整合-分析”的长链式推理 |

| ❌ 对文档结构要求较高 | 格式杂乱文档可能导致检索不准 |

3.未来发展趋势:

五、LightRAG,是人人可用的“知识型AI小助理”

传统RAG是“全副武装”的信息战士,而LightRAG是“灵活迅捷”的斥候,没有GPU你也能用,信息结构不完美也能跑,开发者少也能部署。

在“AI平民化”的浪潮里,LightRAG的存在正是为了:

让更多企业和个人,也拥有属于自己的AI知识大脑。

你可以用它做员工手册助手、做论文笔记助教、做FAQ客服工具……

小巧但实用,轻量但不轻薄。

送上一句“Light级金句”:

AI再强,也要贴地气。LightRAG,不只是轻量化,更是“平民化”。

普通人如何抓住AI大模型的风口?

领取方式在文末

为什么要学习大模型?

目前AI大模型的技术岗位与能力培养随着人工智能技术的迅速发展和应用 , 大模型作为其中的重要组成部分 , 正逐渐成为推动人工智能发展的重要引擎 。大模型以其强大的数据处理和模式识别能力, 广泛应用于自然语言处理 、计算机视觉 、 智能推荐等领域 ,为各行各业带来了革命性的改变和机遇 。

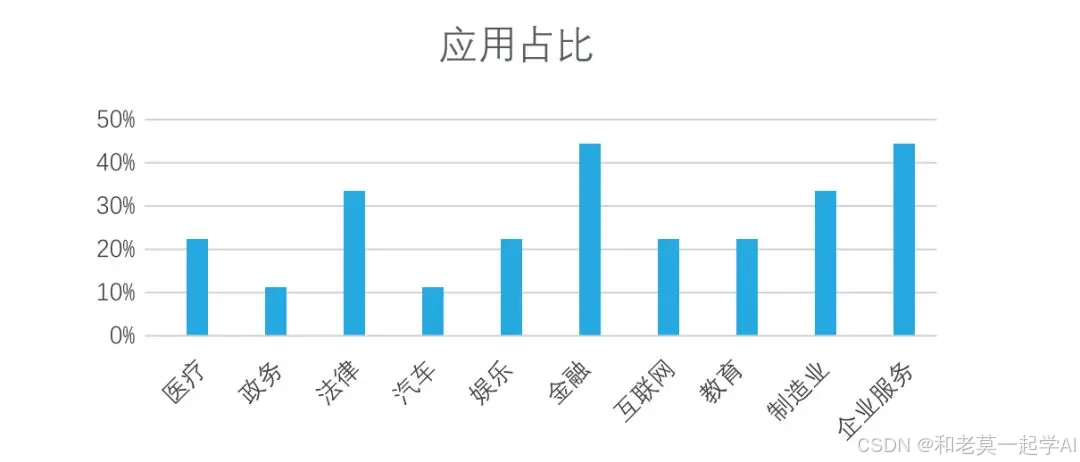

目前,开源人工智能大模型已应用于医疗、政务、法律、汽车、娱乐、金融、互联网、教育、制造业、企业服务等多个场景,其中,应用于金融、企业服务、制造业和法律领域的大模型在本次调研中占比超过 30%。

随着AI大模型技术的迅速发展,相关岗位的需求也日益增加。大模型产业链催生了一批高薪新职业:

人工智能大潮已来,不加入就可能被淘汰。如果你是技术人,尤其是互联网从业者,现在就开始学习AI大模型技术,真的是给你的人生一个重要建议!

最后

只要你真心想学习AI大模型技术,这份精心整理的学习资料我愿意无偿分享给你,但是想学技术去乱搞的人别来找我!

在当前这个人工智能高速发展的时代,AI大模型正在深刻改变各行各业。我国对高水平AI人才的需求也日益增长,真正懂技术、能落地的人才依旧紧缺。我也希望通过这份资料,能够帮助更多有志于AI领域的朋友入门并深入学习。

真诚无偿分享!!!

vx扫描下方二维码即可

加上后会一个个给大家发

大模型全套学习资料展示

自我们与MoPaaS魔泊云合作以来,我们不断打磨课程体系与技术内容,在细节上精益求精,同时在技术层面也新增了许多前沿且实用的内容,力求为大家带来更系统、更实战、更落地的大模型学习体验。

希望这份系统、实用的大模型学习路径,能够帮助你从零入门,进阶到实战,真正掌握AI时代的核心技能!

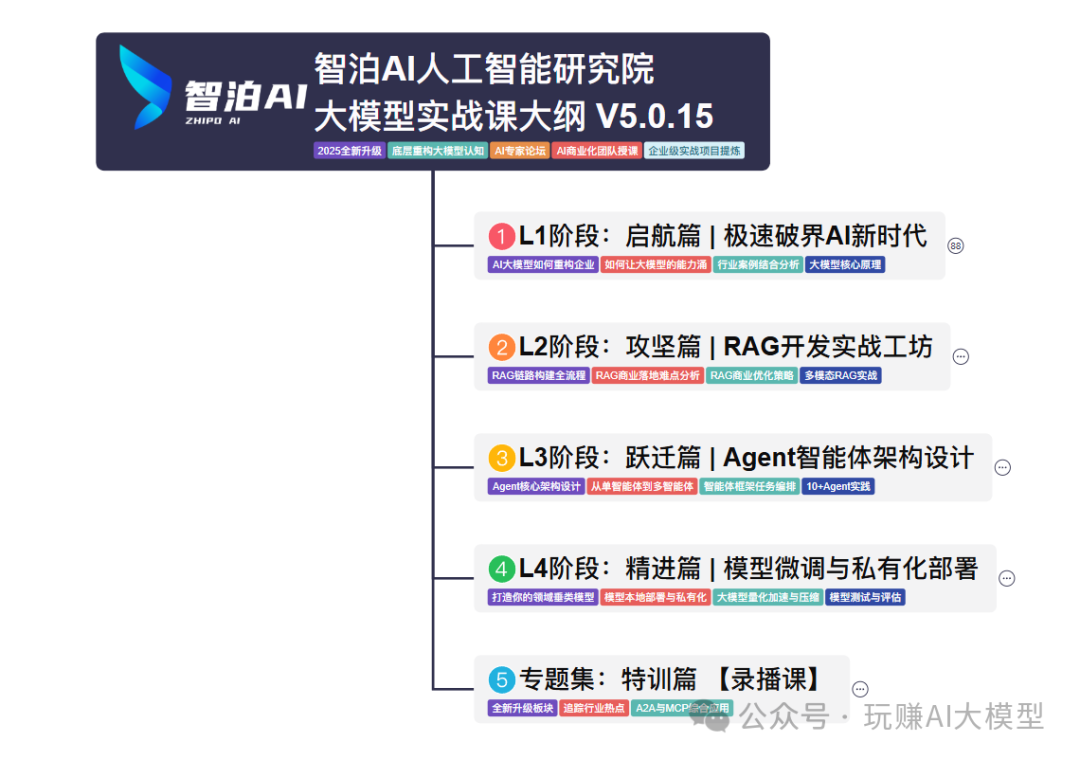

01 教学内容

-

从零到精通完整闭环:【基础理论 →RAG开发 → Agent设计 → 模型微调与私有化部署调→热门技术】5大模块,内容比传统教材更贴近企业实战!

-

大量真实项目案例: 带你亲自上手搞数据清洗、模型调优这些硬核操作,把课本知识变成真本事!

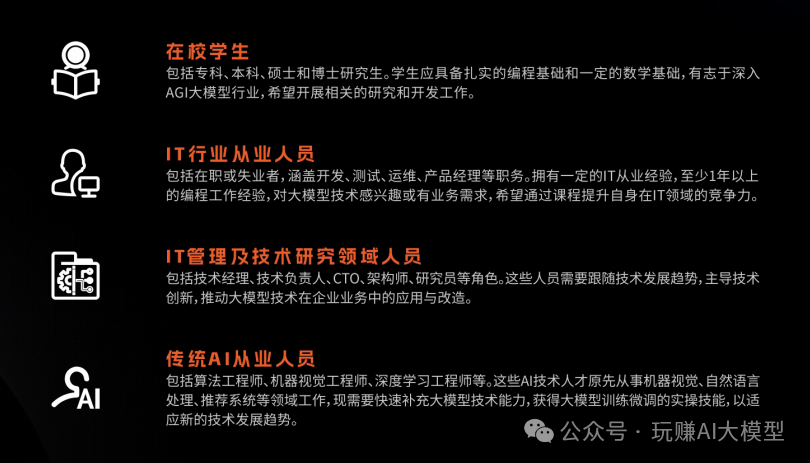

02适学人群

应届毕业生: 无工作经验但想要系统学习AI大模型技术,期待通过实战项目掌握核心技术。

零基础转型: 非技术背景但关注AI应用场景,计划通过低代码工具实现“AI+行业”跨界。

业务赋能突破瓶颈: 传统开发者(Java/前端等)学习Transformer架构与LangChain框架,向AI全栈工程师转型。

vx扫描下方二维码即可

本教程比较珍贵,仅限大家自行学习,不要传播!更严禁商用!

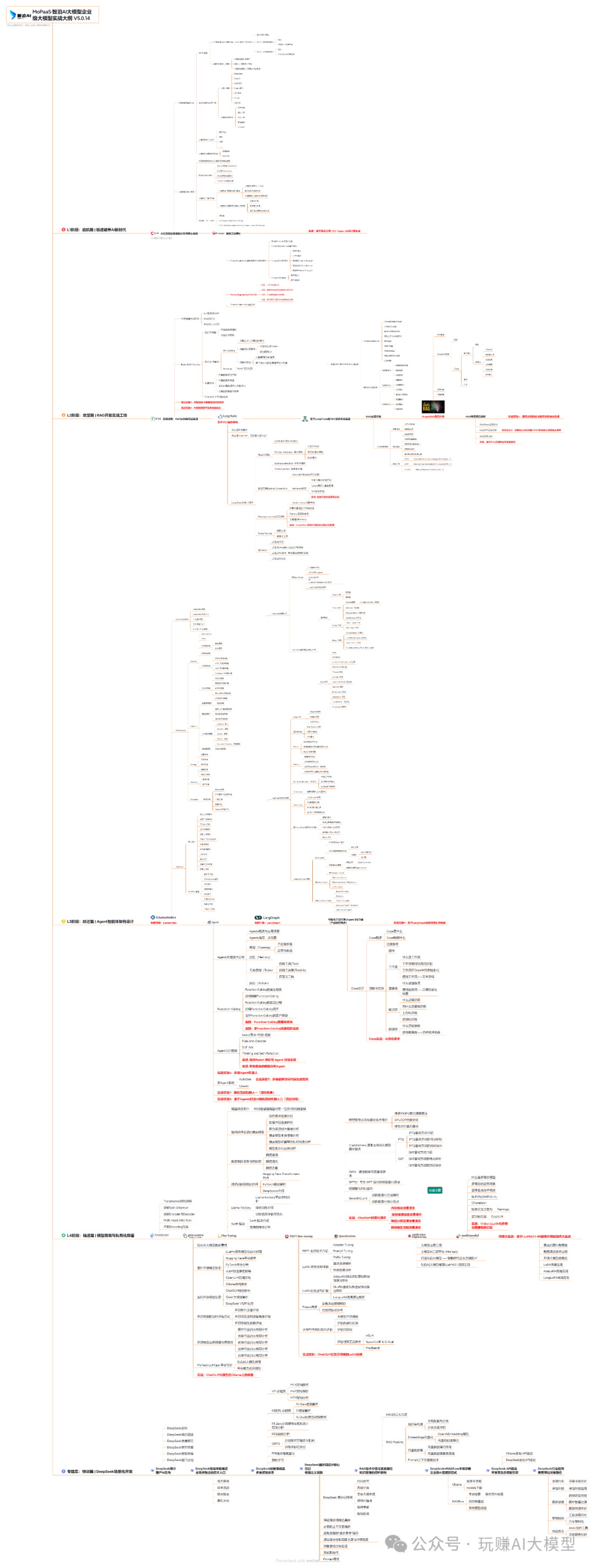

03 入门到进阶学习路线图

大模型学习路线图,整体分为5个大的阶段:

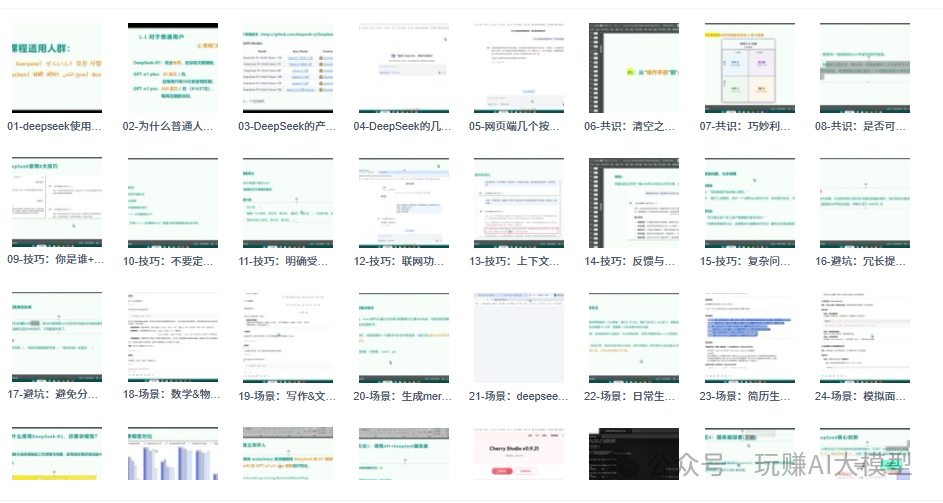

04 视频和书籍PDF合集

从0到掌握主流大模型技术视频教程(涵盖模型训练、微调、RAG、LangChain、Agent开发等实战方向)

新手必备的大模型学习PDF书单来了!全是硬核知识,帮你少走弯路(不吹牛,真有用)

05 行业报告+白皮书合集

收集70+报告与白皮书,了解行业最新动态!

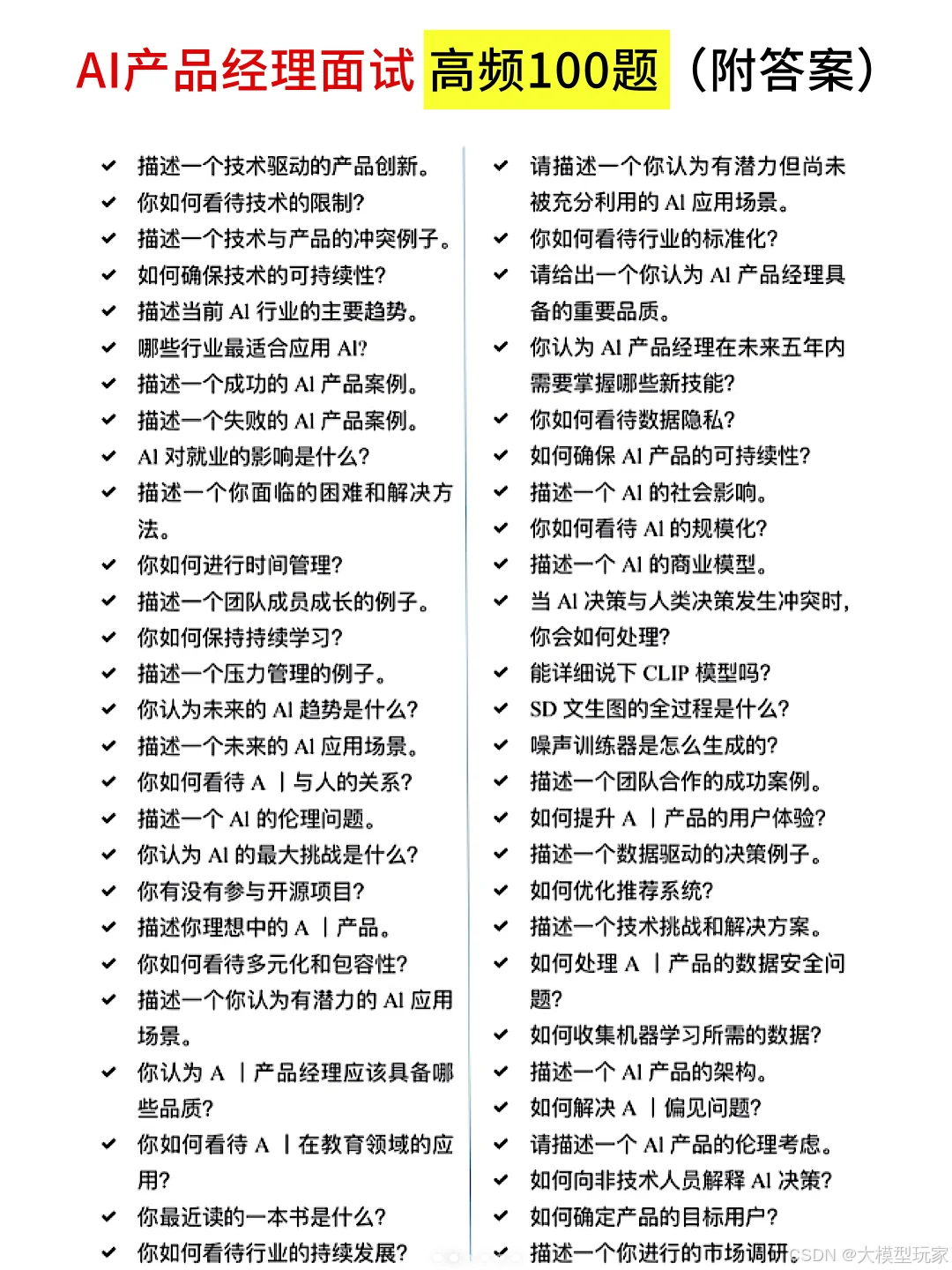

06 90+份面试题/经验

AI大模型岗位面试经验总结(谁学技术不是为了赚$呢,找个好的岗位很重要)

07 deepseek部署包+技巧大全

由于篇幅有限

只展示部分资料

并且还在持续更新中…

真诚无偿分享!!!

vx扫描下方二维码即可

加上后会一个个给大家发

网硕互联帮助中心

网硕互联帮助中心

评论前必须登录!

注册