DeepSeek 赋能数字农业:从智慧种植到产业升级的全链条革新

文章浏览阅读792次,点赞9次,收藏19次。本文聚焦深度求索(DeepSeek)大模型在数字农业领域的创新应用,系统解析其基于 Transformer 架构与混...

文章浏览阅读792次,点赞9次,收藏19次。本文聚焦深度求索(DeepSeek)大模型在数字农业领域的创新应用,系统解析其基于 Transformer 架构与混...

文章浏览阅读760次,点赞28次,收藏7次。【摘要】2025年5月13日,DeepSeek服务器宕机事件引发全民热议,暴露AI基础设施短板,折射出AI普及、社会...

文章浏览阅读673次,点赞4次,收藏8次。如果以上方法均无法解决问题,建议联系DeepSeek官方客服,详细反馈问题情况,包括错误提示、尝试过的解决方法及操作环...

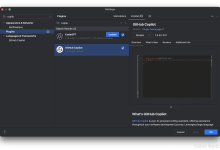

文章浏览阅读728次,点赞17次,收藏19次。为了摆脱服务器繁忙的困扰,本地部署DeepSeek-R1成为了一个绝佳的解决方案,这不仅减少了对网络连接的依赖,还...

文章浏览阅读393次。模型上下文协议:MCP 服务器据称是 AI 领域的下一个重大改变者,它将使 AI 代理变得比我们想象的更加先进。MCP 或模型上下文协议由...

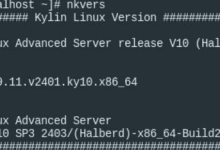

文章浏览阅读696次,点赞4次,收藏4次。银河麒麟服务器操作系统V10安装Nvidia显卡驱动和CUDA(L40)并安装ollama运行DeepSeek【开荒存...

文章浏览阅读3.1w次,点赞245次,收藏191次。《DeepSeek 行业应用大全(微课视频版)》人工智能深度剖析:解锁 AIGC 新生产力!在数字化浪潮席卷...

文章浏览阅读1.6w次,点赞28次,收藏83次。本文介绍了IntelliJ IDEA 接入 AI 编程助手的多种方式,包括,以及本地 AI 部署方案。开发者可根...

文章浏览阅读1.1k次,点赞25次,收藏5次。基于银河麒麟桌面/服务器操作系统的 DeepSeek本地化部署方法【详细自用版】

文章浏览阅读5k次,点赞21次,收藏24次。通过上述步骤,你可以轻松地在Windows上配置Ollama服务,使其能够被局域网中的其他设备访问。具体操作包括:设...